一般財団法人 機械システム振興協会

2026年4月

当協会では、2025年8月に「製造業のAIエージェント」の活用方策フォーラム(委員長:武田 英明 国立情報学研究所 教授)を立ち上げ、製造業における開発、生産プロセス等へのAIエージェントの活用方策と課題について、5回にわたり参加委員及び有識者を交えて議論し、2026年4月に活動報告書をとりまとめました。

以下、活動報告書の全文を掲載いたします。

(注)なお、本コンテンツの著作権は、機械システム振興協会に帰属しますので、無断での転載、再配布等はお控えいただくようお願いいたします。

目次

序章 はじめに

第1章 本フォーラム開催の趣旨と委員構成について

第2章 AIエージェントの特徴と定義及び検討のスコープ

第3章 AIエージェントの活用が期待される分野と配慮すべき点

第4章 自律性の許容範囲(ヒトの介在の程度)に関する考察

第5章 物理系との接続に関する論点の考察

第6章 第三者の権利侵害のおそれとその法的責任に関する考察

第7章 導入に向けた準備(基盤整備)と解決すべき課題

第8章 おわりに ~AIエージェント導入に向けた方針・手順~

Appendix

【トップ画像】Azure gpt-image-1を使用して作成したもの

序章 はじめに

生成AIの急速な技術的進展に伴い、その利活用が実際の企業活動にも普及している。今やAIなしでの企業活動が成り立たないかのような様相を呈している。このような背景の下、機械システム振興協会では、「生成AIの機械システム設計開発への活用フォーラム」(2023年度)及び「生成AI活用に向けた企業なデータの整備検討フォーラム」(2024年度)において、生成AIの利活用について検討してきた。

しかしながら、最近では、更に進んだAIエージェントやエージェント型AI及びフィジカルAI1(以降、これらを区別せずに「AIエージェント」という。)が話題を集めているが、その利用・導入をリードしているのはテクノロジー・ソフトウェア業、金融サービス業及び小売業だと言われている。しかも、その利活用分野は、顧客へのサービス対応支援や社内間接業務での成功が伝えられている。

これらの産業に加え、海外では、製造業の開発・生産プロセスにもAIエージェントが導入され、生産性向上に貢献しているとの由である。他方、我が国の製造業において、これらの技術が開発や生産分野に活用され、実装されているとまで言えるかは未知である。BCG(ボストン・コンサルティング・グループ)の調査では、業務にAIエージェントが組み込まれていると回答した人は7%と世界の平均13%を下回るとの報道もある2。そもそも、AIエージェントのみならず、AI分野での日本の存在感はあまりなく、国際ランキングで9位から10位台前半との報道もある3。

米国の歴史学者ケネス・ポメランツが提言した産業革命期の機械の導入の大小による「大分岐」に倣い、AI利用の度合いにより、AI後進国とAI先進国の分かれ目を「AI時代の大分岐」と表現されることがある4。AIに続き、我が国がAIエージェントの活用でも遅れを取り諸外国の後塵を拝するということになれば、我が国の産業競争力が国際的に劣位に置かれるのではないかとの危機感を持たざるを得ない。 このような問題意識の下、2025年度は、製造業のAIエージェントを取り上げ、開発や生産等のプロセスにおける活用拡大に向けた方策を検討することとした。

1フィジカルAI:ロボットや設備などの「現実のモノ」とつながり、センサで状況を捉えて判断し、動作や制御まで行うAI。

22025年12月24日付け日本経済新聞

32025 年11月10日付け日本経済新聞夕刊

4 井上智洋駒澤大学准教授「AIと雇用[下]」(2025年10月3日付け日本経済新聞 経済教室)

第1章 本フォーラム開催の趣旨と委員構成について

1-1. 趣旨

本報告書は、製造業の開発や生産現場等におけるAIエージェントの活用により期待できる効果が最大限に発揮できるように、導入・運用に向けて必要となる準備(基盤整備)、活用上の留意点及びそれらへの対策を提示することを目的とする。

検討に当たっては、生成AI等とは異なり、限定的な人の介入という状況下で独立したタスクを実行するというAIエージェントの特徴を捉え、「AI利用者」としての視点から、利用上の留意点と導入に向けた準備及び解決すべき技術的・制度的課題を整理する。具体的には、運用時の留意点として、データ基盤整備5、リスクの洗い出しと安全性・信頼性確保、人の介在度合い、物理系への影響等を取り上げ、技術面と法律等制度面の両面から横断的に俯瞰し、課題として整理する。

本報告書の想定される読者は、製造業の経営層、部門責任者、現場責任者、社内システム責任者を主たる読者層とし、あわせてAI開発者・AI提供者や政策立案・実施部門の関係者等の参考に供する。

昭和の時代からヒューマノイド・ロボットの概念に親しみ、多様なコンピューターゲームを楽しんできた日本人は、本来デジタルと付き合うのが得意なはずであるが、会社や仕事となるとこれらの技術を利用する勢いが弱まるとの意見がある6。その理由の一つとして、「日本は幹部層の経歴に多様性がなく、業界の常識やくびきから離れられない。」ということを挙げ、警鐘を鳴らす声もある。この言説の真偽を問うのは本報告書の目的ではない。こうした懸念が杞憂であったと言われるように、特に製造業の幹部層の皆様に是非お読みいただき、製造業においてAIエージェントの活用が進展する一助となれば幸いである。

5 データ基盤:企業や組織が、保有するデータを収集・蓄積し、データ部分析などのためにデータの利用者が活用しやすいように加工・整理した状態で保有・提供するための仕組みのこと

6夏野剛KADOKAWA社長(2025年12月24日付け日本経済新聞)

1-2. フォーラム委員

| 委員 | 所属 | 役職 |

| [委員長] 武田 英明 | 国立情報学研究所 情報学プリンシプル研究系 | 教授 |

| [委員]石垣 達也 | 国立研究開発法人 産業技術総合研究所 人工知能研究センター 言語情報研究チーム | 研究員 |

| 石川 冬樹 | 国立情報学研究所 アーキテクチャ科学研究系 | 准教授 |

| 江越 博昭 | BCC株式会社 | 取締役 |

| 岡田 忠 | 独立行政法人情報処理推進機構 デジタル基盤センター デジタルエンジニアリング部 (併任) AIシステムグループ | エキスパート |

| 佐藤 適斎 | アズビル株式会社 デジタル推進本部 デジタルそうぞう部 デジタルイノベーションLabグループ | グループマネージャ |

| 田中 紀子 | 株式会社荏原製作所 データストラテジーチーム データストラテジーユニット(兼)データエンジニアリンググループ | ユニットリーダー |

| 九十九 弘 | 旭化成株式会社 IT・DX統括部 | デジタルイノベーション推進部長 |

| 富重 将司 | 旭化成株式会社 生産技術本部 生産技術センター | 産機システム技術部長 |

| 中川 友紀子 | 株式会社アールティ | 代表取締役 |

| 中村 哲 | 株式会社デンソー 生産技術部 | 担当部長 |

| 宮本 淳一 | 株式会社PFU ビジネスプラットフォーム本部 プロセスDXセンター | センター長 |

| 村上 存 | 東京大学 大学院工学系研究科 機械工学専攻 | 教授 |

| 山田 宗範 | 一般財団法人機械システム振興協会 | 専務理事 |

| [専門委員] 島田 由希子 | 東京大学 大学院工学系研究科 機械工学専攻 設計工学研究室 | |

| [オブザーバ] | 独立行政法人情報処理推進機構 デジタル基盤センター デジタルエンジニアリング部 AI システムグループ / AIセーフティ・インスティテュート | |

| 経済産業省 商務情報政策局 情報経済課 | ||

| [事務局] | 機械システム振興協会 相澤 徹、杉浦 秀明、井上 さゆき、徳力 空海、柴田 紗央里 |

(写真)第1回 フォーラム参加者

第2章 AIエージェントの特徴と定義及び検討のスコープ

本章では、本フォーラムにおける検討の前提として、AIエージェントの特徴と、本フォーラムが対象とする検討のスコープを整理する。まず、AIエージェントの定義と活用場面における特徴を明確化した上で、限定的な人の介在の下で自律的にタスクを実行するという性格及び物理系との接続を伴い得るという点を踏まえ、検討上の視点と立場を示す。併せて、本報告書が主としてAI利用者の立場から論点を整理することを明確にし、以降の章で扱う検討事項との関係を示す。

2-1. AIエージェントの変遷と活用動向

(1) AIエージェントの発展の変遷

近年、AIエージェントという概念が広く認知されつつある。従来、AIに任せる範囲は比較的はっきりしており、入力と出力の形が定まった処理を安定して実行させる使い方が中心であった。そこから、状況に応じて手順を考え直し、必要に応じて外部の情報源やツールも使いながら、作業を段階的に進める形へと関心が広がってきている。本節では、従来型AIから大規模言語モデル(LLM7)を取り込んだAIエージェントへ至る流れを、技術の変化と実装のしやすさの観点からまとめる。

従来のAIは、識別や予測を中心に入力と出力の形があらかじめ決まった処理を安定して回す形で使われてきた。目的に合わせてルールを書いたり、学習データを集めたりして精度を作り込み、想定した条件の中で性能を確保する進め方である。条件が整った環境では強い一方で、扱う状況が増えるほど例外や分岐が増え、設計、データ準備、更新の負担が大きくなりやすいという課題が残りやすい。

ここ数年で状況が変わった理由として、まずLLMの技術的なインパクトがある。2022年前後からLLMが広く利用されるようになり、指示文や少数の例を与えるだけで、追加学習をせずに新しいタスクへ対応できる入口が整ってきた。少数ショット学習(in-context learning)8が成立したことで、従来は手間がかかり易かったルールの細かな記述や用途ごとに作り込んだ学習データの大量準備を、一部置き換えられる場面が増えている。まず動くものを作り、短いサイクルで確かめながら直すという進め方が取りやすくなったことが、関心の高まりにつながっている。

7LLM(Large Language Model):大規模言語モデル。人間が扱う自然言語をニューラルネットワーク上にて処理するための技術のこと。文章を一定の単位に分割し数値(ベクトル)化し、数値データとして学習、検索できる。例えばChatGPTはLLMを活用して実現されている。

8少数ショット学習(in-context learning):大規模言語モデルに対し、追加学習を行わずに、プロンプト内で少数の例題と正解例を提示して振る舞いを誘導する手法である。例の与え方によって、分類、要約、抽出、書式整形などのタスクをその場で遂行できる。

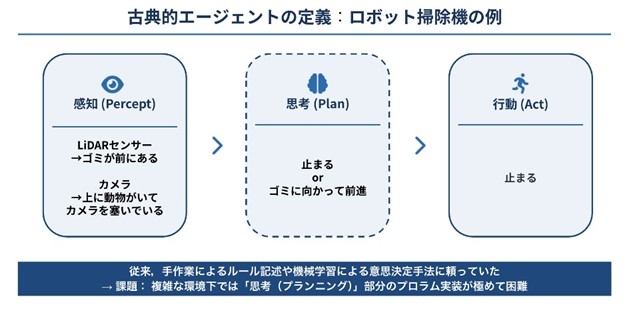

この流れを理解するために、古典的なAI研究で扱われてきたエージェントの定義を押さえてみることが有益である。エージェントは、環境からデータを取り込み、次の行動を決め、実行し、結果を受けて次に回す仕組みである。流れで書くと、感知(Perception)→プランニング(Planning)→行動(Action)→フィードバック(Feedback)、となる。単発の処理ではなく、環境の変化を取り込みながらこの流れが繰り返される点が要点である。

ロボット掃除機を例にすると、この定義の意味が分かりやすい。LiDAR9やカメラなどで周囲の状況を捉え、ゴミや障害物の有無を把握する。次に、停止するか、方向を変えるか、ゴミへ向かうかといった方針を考える。実際にモータを動かして走行すると、障害物に近づいた、想定より狭い通路だった、電池残量が減ったといった新しい状況が得られる。得られた状況を次の判断へ戻し、この循環を続ける。一方で従来は、壁に近づいたら方向転換、電池残量が一定以下なら充電台へ戻るといった条件分岐を、人手で細かくルール化する必要があった。しかし環境が複雑になるほど分岐や例外が増え、ルールは膨張しやすく、整合の維持や保守が難しくなる。さらに、複数のセンサが返す値の組合せは膨大であり、手作業の記述や従来型の機械学習だけでは十分に扱いきれない場面が出やすい(【図2-1】参照)。

【図2-1】 古典的エージェントの例

【出典】 第1回フォーラム 石垣委員の発表資料をもとに、事務局が作成(原典:Li, Xinzhe, 2024, “A Review of Prominent Paradigms for LLM-Based Agents: Tool Use (Including RAG), Planning, and Feedback Learning,” arXiv:2406.05804.)。

9LiDAR:レーザー光を照射し、その反射の時間差などから対象までの距離を計測して周囲の形状を三次元的に把握するセンシング方式である。ロボットや車両の自己位置推定、障害物検知、環境地図作成などに用いられる。

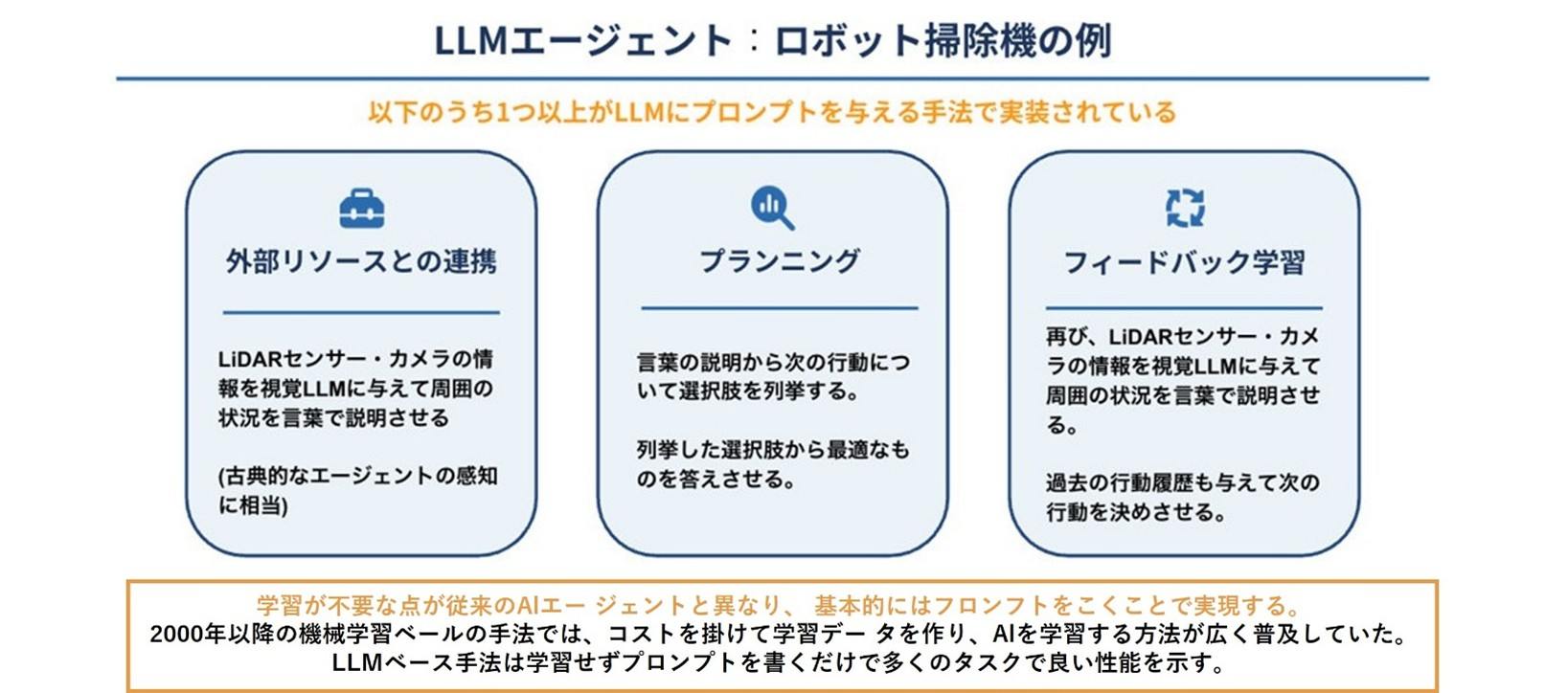

それに対してLLMを取り込むと、この循環構造は保ったまま、特にプランニングの作り方が変わる。周囲の状況を文章として与え、次に取るべき行動案を列挙させたり、複数案の中から選ばせたりできる。画像入力が可能なLLMであれば、カメラ画像を入力し、状況の説明を経由して行動を決める流れも構成できる。ロボット掃除機の例で言えば、センサや画像で得た状況を言葉で表し、その説明に基づいて次の行動を決める形となる。従来はルールや個別学習で作り込んでいた分岐や例外対応の一部を、まずはプロンプト設計で試せるようになる。

さらに、外部リソースとの連携が加わると、この循環が実務に近い形で回りやすくなる。検索やデータ参照、計算、業務システムの呼び出しなどを組み合わせることで、モデル単体の知識だけに頼らず、必要な情報を取りに行って計画を更新し、実行し、結果を取り込んで次の修正につなげられる。自動コーディングは分かりやすい例であり、コード生成に加えて、ライブラリの使い方を調べ、実行エラーを受け取り、修正して再実行する流れがまとまって回る。外部リソース連携、プランニング、フィードバックのいずれかをLLMで担わせる形が近年のLLMエージェントの定義として扱われることがある(【図2-2】参照)。 ただし、研究者間では、LLMエージェントの厳密な定義はまだ統一されておらず、定義の揺れを避けるため、あえて「エージェント」という語を使わない研究もある。

以上を踏まえると、AIエージェントが着目される理由は、感知→プランニング→行動→フィードバックという循環のうち、従来は作り込みが重かった部分を、LLMと外部連携によって比較的小さな実装で試しやすくなった点にある。ソフトウェアに限らず、ハードウェアや現場環境ともつながる形で応用が語られるようになった背景には、この実装可能性の変化がある。

【図2-2】 LLMエージェントの例

【出典】 第1回フォーラム 石垣委員の発表資料をもとに、事務局が作成(原典:Li, Xinzhe, 2024, “A Review of Prominent Paradigms for LLM-Based Agents: Tool Use (Including RAG), Planning, and Feedback Learning,” arXiv:2406.05804.)。

(2) AIエージェントの利用動向

近年、AIエージェントという概念が広く認知されつつある。背景には、AIが担える役割が、入力に対して出力を返す単発の処理から、手順の検討、外部ツールの利用、結果の確認とやり直しまで含めて、一連の作業を回す形へ広がってきたことがある。ここでは、利用動向を非製造業と製造業に分けて整理し、製造業で論点になりやすい適用範囲の広げ方も併せてまとめる。

①非製造業における利用動向

非製造業では、作業対象がソフトウェア上で完結する場面が多い。そのため、外部ツールの呼び出し、手順の組み立て、結果の受け取りと修正を、比較的閉じた環境で反復しやすい。 以下に、事例を二つ取り上げる。

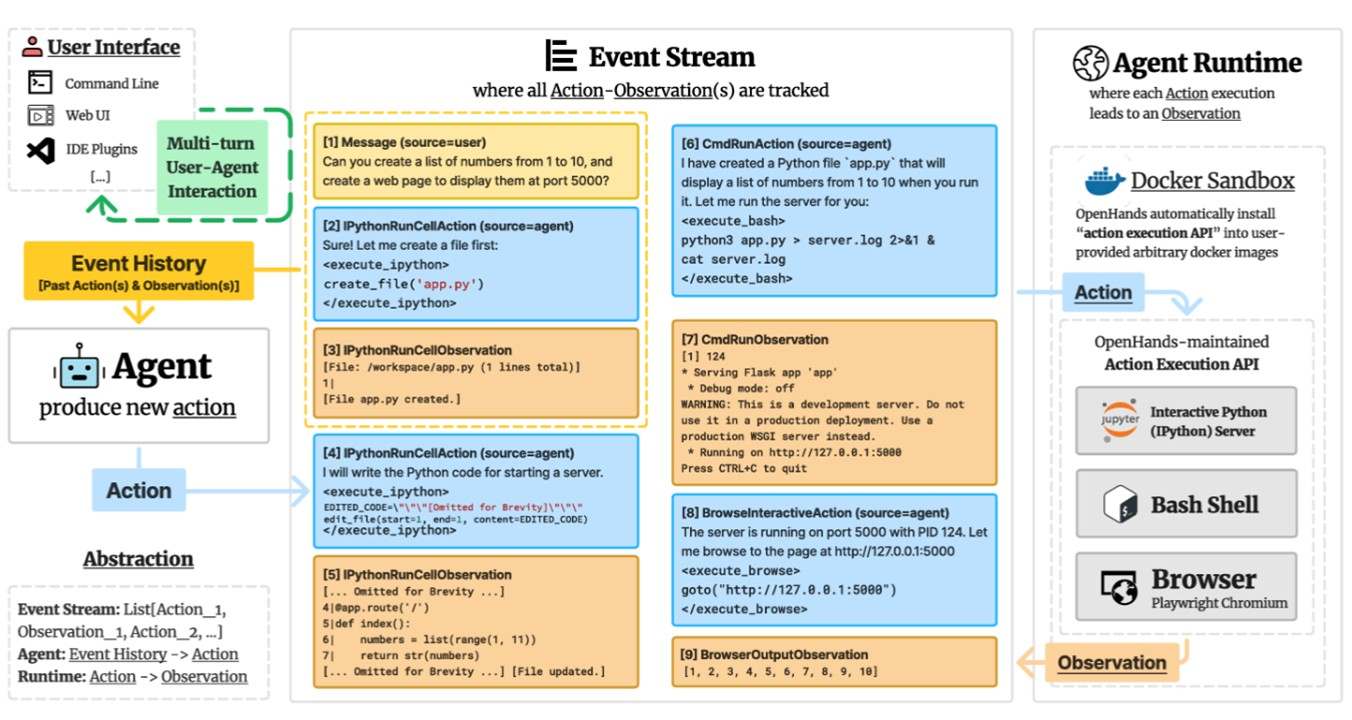

a) 自動コーディングエージェント

自動コーディングでは、指示内容を踏まえて必要な作業を分解し、ファイル作成、実装、実行、失敗時の修正を連続して進める構成が代表的である。具体例として、コーディングエージェントOpenHandsを紹介する。これは、コード編集、実行環境、ブラウザやシェルなどの外部ツールを同一の作業空間に統合し、実行結果やエラーを手がかりに修正を繰り返す流れを想定している。エージェントが次の一手を選ぶ上で、コンパイラの警告、実行ログ、検索結果などがフィードバックとして働く点が重要である。これは、手順の作成と実行、結果に基づく修正が短い周期で回りやすい領域であることを示す(【図2-3】参照)。

【図2-3】 コーディングエージェントOpenHandsの動作原理

【出典】 Wang, Xingyao, et al., 2024, OpenHands: An Open Platform for AI Software Developers as Generalist Agents, arXiv:2407.16741. より抜粋。

b) 研究テーマ発想エージェント

研究テーマ発想では、単一の回答を出すのではなく、候補を多数作り、評価で絞り込み、残すべき案に収束させる流れが中心となる。VIRSCIという研究テーマ発想エージェントは、複数の仮想研究者を立て、メンバー選定、議論による方針の定義、アイデア生成、既存研究との近さを踏まえた新規性評価、要約生成、自己点検といった工程を段階的に進める構成となっている。論文データベースを参照しつつ、議論と投票の反復で候補を淘汰する点が、単発の生成と異なる。

②製造業における利用動向

製造業はソフトウェアの世界に閉じないため、ハードウェア特有の難しさが入り込む一方で、ハードウェアからのフィードバックを得られれば、LLMエージェントの活用可能性は大きい。すなわち、現場データの取得と、取得したデータを用いた判断と再計画が、適用範囲を左右する。以下、事例を二つ取り上げる。

a) 工場技術者向けの質問応答エージェント

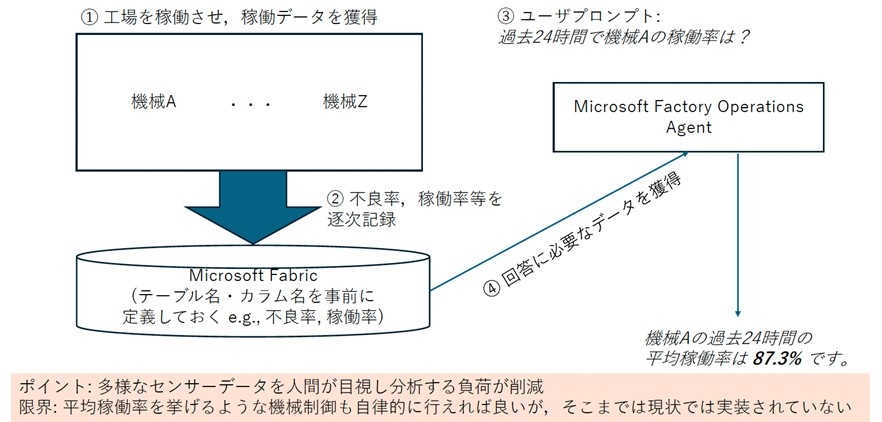

工場技術者向けの質問応答では、現場の稼働データや品質データを蓄積した基盤を用意し、自然言語の質問に対して必要なデータを検索し、要約して返す形が中心となる。シェフラー社のドイツ・ハンブルク工場の例では、工場で得られる稼働データをMicrosoft Fabric10に蓄積し、Microsoft Factory Operations Agentが質問に応じて回答に必要なデータを取り出し、集計結果を返す流れが示されている。多様なセンサデータを人が目視で追って原因を切り分ける負荷を下げられる点が価値となる一方、回答の先に機械制御まで自律的に踏み込む段階には至っていない(【図2-4】参照)。

【図2-4】工場技術者向け質問応答エージェントの構成

【出典】第1回フォーラム 石垣委員発表資料より抜粋(原典:Brandom, Russell, 2025, AI Assistants Join the Factory Floor, WIRED.) 。

10 Microsoft Fabric:Microsoftが提供するクラウドサービスで、社内外のデータの取り込み、準備、保存、分析、可視化といった一連の作業を1つの基盤で扱えるようにするプラットフォーム。複数の担当やツールに分かれがちなデータ活用の流れをつなぎ、同じデータを前提に分析や可視化まで進めやすくする。 https://www.microsoft.com/ja-jp/microsoft-fabric

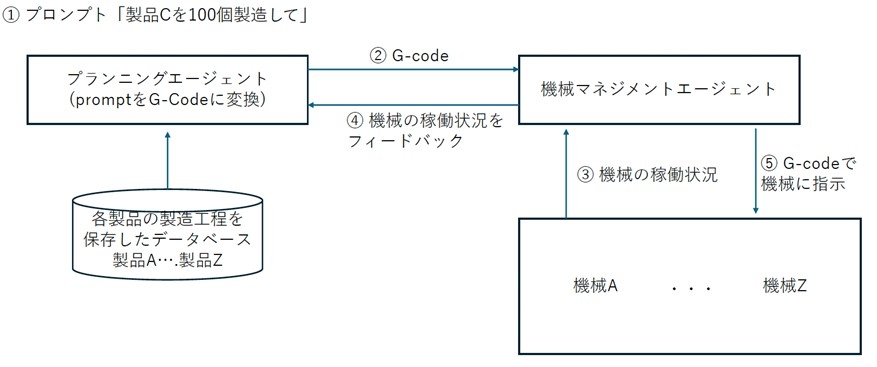

b) 半自動製造工場エージェント

工程計画と機械管理を協調させる形として、自然言語の要求を工程に落とし込み、機械の稼働状況に合わせて再計画する構成がある。ミュンヘン工科大学Limらにより、多くの製品を同時に作る工場において、自然言語で機械に指示を出すシステムが提案された。検討例では、製品の製造要求を起点に、工程データベースを参照して手順を作り、機械側の状態を踏まえて指示を更新する流れが示されている。ここでは、計画を立てる側と、工場内の機械状況を監視する側の役割を分け、生成した指示が通らない場合に計画へ戻す反復が中核となる(【図2-5】参照)。

【図2-5】 半自動製造工場エージェントの構成

【出典】第1回フォーラム 石垣委員発表資料より抜粋(原典:Lim, Jonghan, Vogel-Heuser, Birgit, and Kovalenko, Ilya, 2024, Large Language Model-Enabled Multi-Agent Manufacturing Systems, arXiv:2406.01893.)。

事例を二つ取り上げたが、製造業では適用範囲をどの順序で広げるかが論点になりやすい。第一に、ハードウェア側の状態を十分に取得できない場合が多く、すべての機械・センサを一気にIoT化して扱える状態にすることは容易ではない。第二に、誤推論の影響が大きく、工場停止などの損失が拡大し得る。したがって、まずは質問応答のようにリスクが比較的小さい現場支援から入り、データ基盤と運用の成熟に合わせて、段階的に制御や最適化へ広げる考え方が合いやすい。

(3) 物理系とつながる活用事例(人型協調ロボットの事例)

実世界とつながるAIの活用では、画面上の情報処理にとどまらず、人や設備、搬送物といった現場の要素と噛み合って動くことが求められる。現場は環境変動が大きく、作業対象も毎回同一ではない。さらに、安全面の制約の中で止めずに回す運用が前提になるため、AIだけで完結せず、ロボットや周辺機器、現場システムまで含めた一体設計が重要になる。

国内の具体例として、アールティ社の食品工場向け人型協調ロボットFoodlyがある。冷凍食品のピッキングや詰め作業のように、低温環境で単調作業が続き、人が作業すると短時間で交代が必要になりやすい工程では、現場負担が大きい。Foodlyは、狭い作業空間でも人の隣で作業を分担できる形を志向し、コンベアライン上で人と並走して盛り付け作業を担う(【図2-6】参照)。食品製造では、形状や配置が毎回そろわない対象を扱う場面も多い。箱や容器の中に山積みになった食材を1つずつ取り出す、いわゆるばら積みピッキングでは、対象物のばらつきが大きいほど難度が上がるため、周囲環境を見ながら動作を組み立て、必要に応じて立て直す能力が重要になる。Foodlyでは、ばら積みの不定形物を対象にした取り出し機能を前面に置き、現場で繰り返し発生する取り分け・投入の手間をロボット側で吸収する方向を狙っている。

【図2-6】 人型協働ロボットFoodlyの作業イメージ

【出典】第2回フォーラム 中川委員発表資料より抜粋。

このように、物理対象を扱う作業では、認識だけでなく動作の安全性と復帰性まで含めて、現場で回る形に落とし込むことが要点になる。物理系の現場で特に論点になりやすいのは、止まらない運用と安全を両立させる設計である。人が近接して働く現場では、想定外の接触や介入が起き得る。単に停止して安全を確保するだけでは稼働率が落ち、運用として成立しにくい。そこで、周辺状況を捉え、危険があれば減速・回避しつつ、作業を中断しても復帰できるよう手順を組み替える、といった振る舞いが必要になる。このように、認識・推論・制御を一体で扱い、ロボットという身体を通じて実世界に作用させる領域は、フィジカルAIの文脈で語られることが多い。

海外に目を向けると、米中欧において人型ロボットの研究開発は自動車産業を中心に加速している。背景には少子高齢化による採用難があり、とりわけ自動車工場では体力依存の作業が多く、現場の厳しさを示す言い回しとして「35歳定年説」が語られることもある。こうした人員制約の中で、搬送、組付け補助、検査、段取り替えなど、人が現場で担ってきた役割を補完できる可能性が注目され、米中欧の自動車系企業で投資が活発化している。さらに、次世代産業の柱としての期待から、韓国・ベトナム・シンガポールなどでも資金投入が進み、研究から実証へと裾野が広がりつつある。

一方で、導入の時期については慎重な見方も必要である。ヒューマノイド・ロボットはまだ未成熟であり、本格的な普及は2035〜2045年を見通す声がある。米中で関連報道が多いことは事実だが、それは進展が容易というより、むしろニュースになるほど難易度が高く、実環境での信頼性確保や安全性担保が大きな課題であることの裏返しとも捉えられる。したがって、現時点では、人型ロボット単体の性能向上だけでなく、現場の安全設計、作業復帰の仕組み、設備や人との協働を含む運用の作り込みが、実用化に向けた主要な論点となる。

(4) マルチエージェントの研究動向

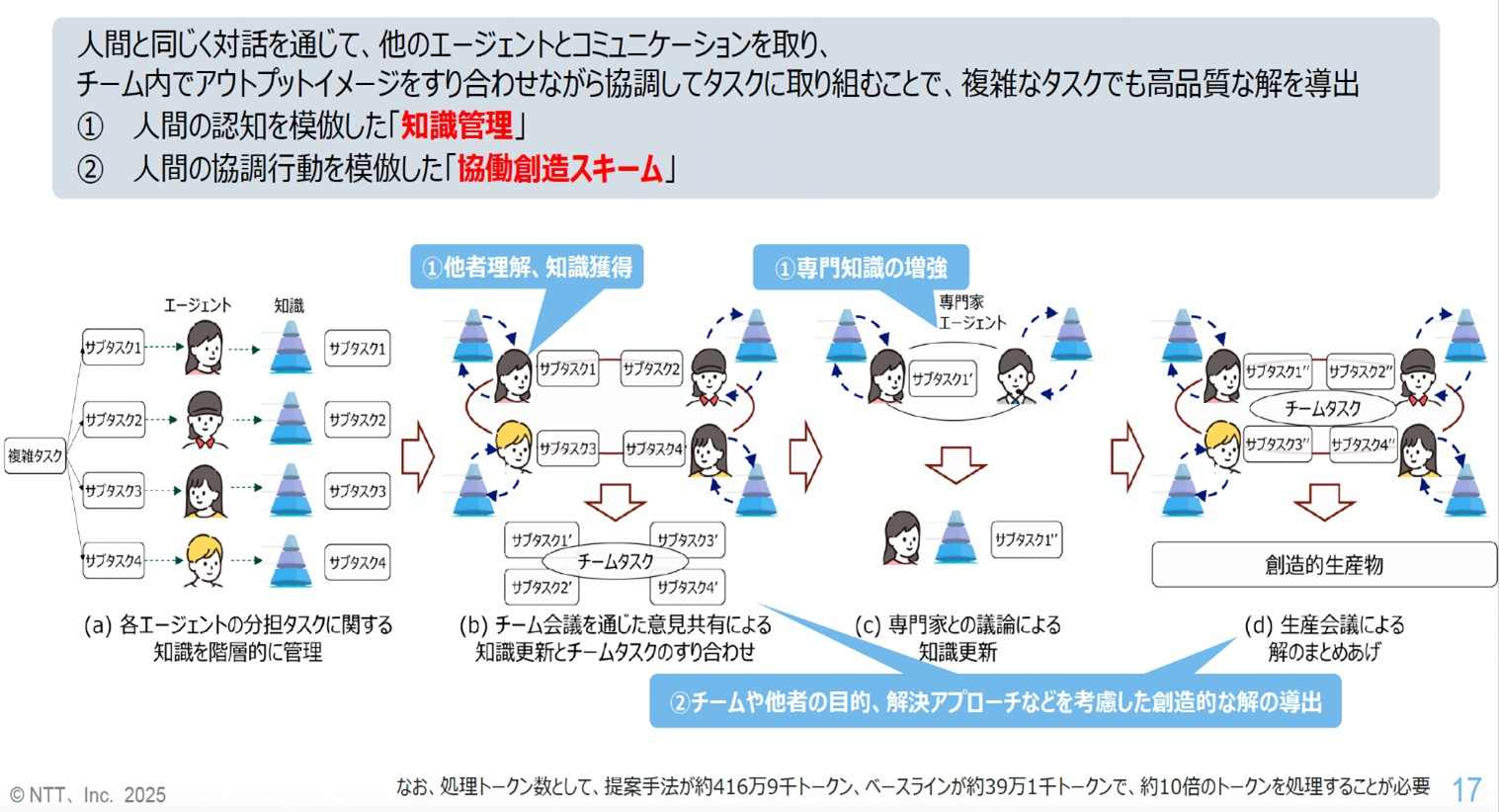

マルチエージェントとは、複数のAIエージェントが協力し合いながらタスクを遂行する仕組みである。近年は、複雑なタスクでも品質を高めながらまとめ上げるために、複数エージェントの協調プロセスを枠組みとして設計する研究が進んでいる。

以下の内容は、第4回フォーラム委員会の場における、NTT人間情報研究所 中辻 真 様による研究活動に関する説明内容をもとに、事務局が作成したものである。

NTTでは、人とAIが共生し、ともに成長する関係を目標にHuman-AI協調の研究に取り組んでおり、対話技術の発展とLLMの登場により、ユーザーの意図を汲み取って作業を代行する局面が広がっている。こうした流れの延長として、複数のAIエージェントが相互に対話しながらアウトプット像をすり合わせ、複雑なタスクでも高品質にまとめ上げるための枠組みが検討されている。そこで本項では、NTTでのマルチエージェントの研究動向として、複数エージェントの自律協調を支えるACTという技術と、企画から実装までの多段階プロセスを統括するメタエージェントの枠組みを取り上げ、具体例とともに整理する。

① ACT:AIエージェント自律協調の基盤技術

ACT(Knowledgeable Agents to Design and Perform Complex Tasks)は、複数のAIエージェントが対話を通じてアウトプット像をすり合わせ、複雑なタスクでも成果物の品質を高めながら収束させることを狙う自律協調の枠組みである。従来型の「サブタスク分割→個別検討→単純統合」では、各担当の結論が並列に並ぶだけになりやすく、相互学習や一貫性の形成が弱くなる点が課題となる。そこでACTでは、相互対話と知識増強を工程に組み込み、チームとしての目的や解法の整合を取りながら進める設計としている。

具体的には、複雑タスクが入力されるとサブタスクに分割され、複数エージェントに割り当てられる。各エージェントは担当サブタスクに必要な知識をその場で構築し、進行中に不足知識が生じた場合は、知識の専門家との対話を挟んで必要知識を補強する。次に、各エージェントがチームタスクへの意見表明を行い、意見共有を通じて知識を更新する。さらにランダムに選ばれたリーダーが、チームとしての共通目的を再定義し、タスク定義自体をブラッシュアップした上で、最終的にサブタスク解決と統合を行い、チーム成果物へ収束させる流れとなっている(【図2-7】参照)。

また、各エージェントが獲得した知識は会話を通じて共有され、会話過程を整理したエピソードとして保持される。この知識は次のタスクに再利用できる形で汎用知識へ抽象化され、コンセプト、キーワード、会話の要約という3層で整理する。タスク解決に必要な知識だけでなく、相手の印象や特性情報も次回対話に活かす形を取る。

【図2-7】 ACTによるチーム会議フロー

【出典】 第4回フォーラム委員会 中辻真 氏(NTT人現情報研究所)説明資料より引用。

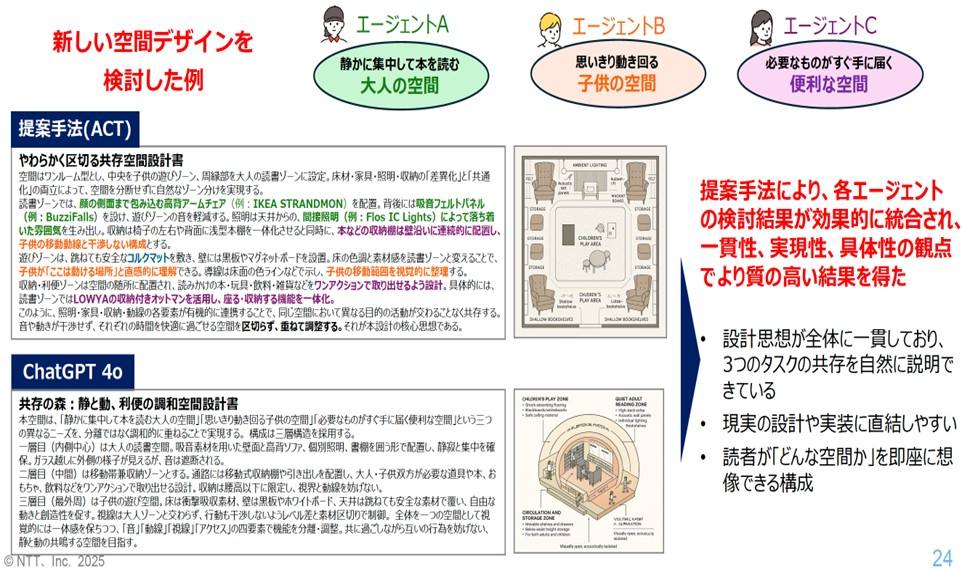

このように、複数の観点が衝突しやすい状況でも、単純に案を寄せ集めるのではなく、目的や前提を揃え直しながら統合に至る点がACTの特徴である。ここでは、ChatGPTによる提案とACTによる提案を比較した事例を2例紹介する。

1例目は、相反する要望を両立する空間配置を行った事例である。家族が同じ空間で過ごすことを前提に、子どもの遊びと大人の読書という性質の異なる要求を両立させる配置が求められた。ChatGPTは、読書空間と子ども空間を囲い込み型に分離し、完全に分ける配置になりやすく、同一空間で共に過ごす解決に寄りにくい結果となった。一方ACTでは、中央に子どもの遊びエリアを置き、カーペット等で区画を整理しつつ、壁沿いに大人がリラックスして読書できる空間を配置する案となった。さらに間接照明により中央が眩しくなりにくい配慮も組み込まれ、同一空間で共に過ごす前提を維持した統合案へ収束した(【図2-8】参照)。

【図2-8】 新しい空間デザイン検討におけるACTとChatGPTの生成結果比較

【出典】 第4回フォーラム 中辻真氏(NTT人間情報研究所)説明資料より引用。

2例目は、旅行プランの立案である。複数人で旅行する状況を想定し、参加者それぞれの目的が異なる中でも、一緒に行く価値が残る旅程へまとめ上げることが求められた。ChatGPTでは、各観点の提案が並列に並びやすく、全体としての一体感が薄いプランになりやすい結果となった。ACTでは、複数エージェントが議論とすり合わせを行い、各エージェントの目的が旅程のどこに反映されたかを確認できる形で統合したプランとなった。外部知識も参照して旅程が精緻化され、信頼性を担保する方向で収束した。

以上の事例から、ChatGPTは要望を分離したり観点ごとの提案を並べたりしやすいのに対し、ACTは複数の要望や目的を同じ前提の下で突き合わせ、全体として一貫した統合案へ収束させやすいことが分かる。

② メタエージェント導入による全体統括

マルチエージェントの協働を、単発のタスク解決に留めず、企画から仕様、実装のような多段階プロセスへ拡張する方向が検討されている。その中核として、全体統制を担うメタエージェントを置く。メタエージェントは、チーム編成と役割分担の最適化、検討経緯や知識やプロセスの共有、大局的な方針付けと具体化の促進を担い、企画書や仕様への申し送りや修正指示を介して改善ループを回す。人間のコメント意図も取り込み、途中で追加要求が入っても企画や仕様を再構成できるようにして、アウトプットを戦略に沿う形へ寄せていく。

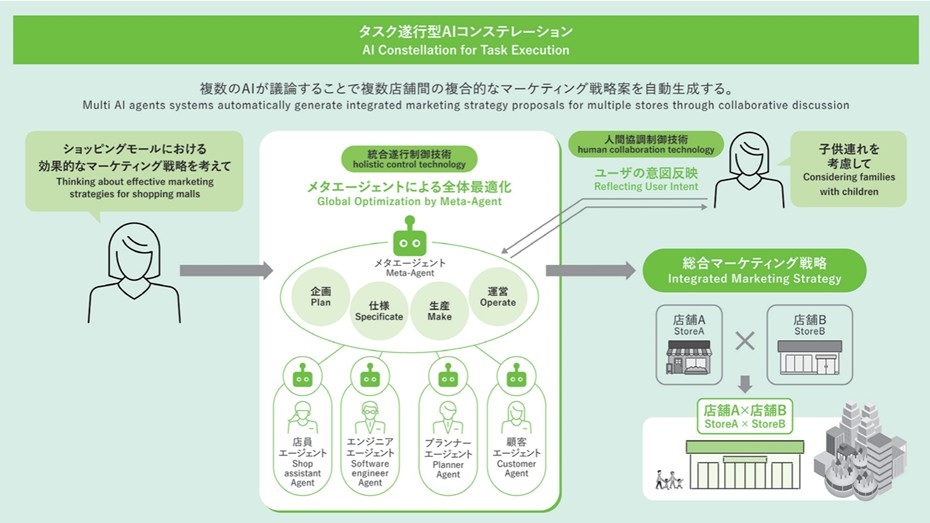

参考として、NTT R&Dフォーラム2025では、メタエージェントの考え方を踏まえたデモとして「タスク遂行型AIコンステレーション」が紹介された。調査、企画、設計、表現といった複数プロセスを横断するタスクに対して、プロセス間のつながりを保ちながら人間の意図を確認しつつ更新し、全体として筋の通った提案へまとめ上げることを目指すものである(【図2-9】参照)。

【図2-9】 タスク遂行型AIコンステレーションにおけるメタエージェントの全体統括イメージ

【出典】 NTT R&Dフォーラム2025 出展資料「タスク遂行型AIコンステレーション(#A07)」より引用(https://www.rd.ntt/forum/2025/doc/A07-j.pdf)。

その適用事例として、紅茶ショップとデザインショップなど複数店舗を含むエリアを対象に、店舗単体の戦略とエリア全体での共同戦略を両立させる設計が提案された。紅茶ショップ側では、展示・確認からテイスティング、抽出体験を経て購入促進へ至る顧客導線が組み込まれ、体験の深さを起点に送客と購買をつなげる構成となった。また、中央空間に紅茶のアロマ関連商品やインテリア等を配置し、体験を通じて各ショップへ誘導する設計も含まれた。家族連れ等のターゲットに応じて空間と動線を調整する観点も含み、店舗内の設計とエリア全体の回遊設計を同一の狙いに沿ってまとめ上げる生成結果となった。

(5) 海外諸国で進む活用と日本の課題

本項では、第4回フォーラム委員会における、旭化成 九十九委員の発表内容に基づいて、研究開発分野でAIエージェントの活用が進む海外事例を、日本の現状と対比しながら紹介する。

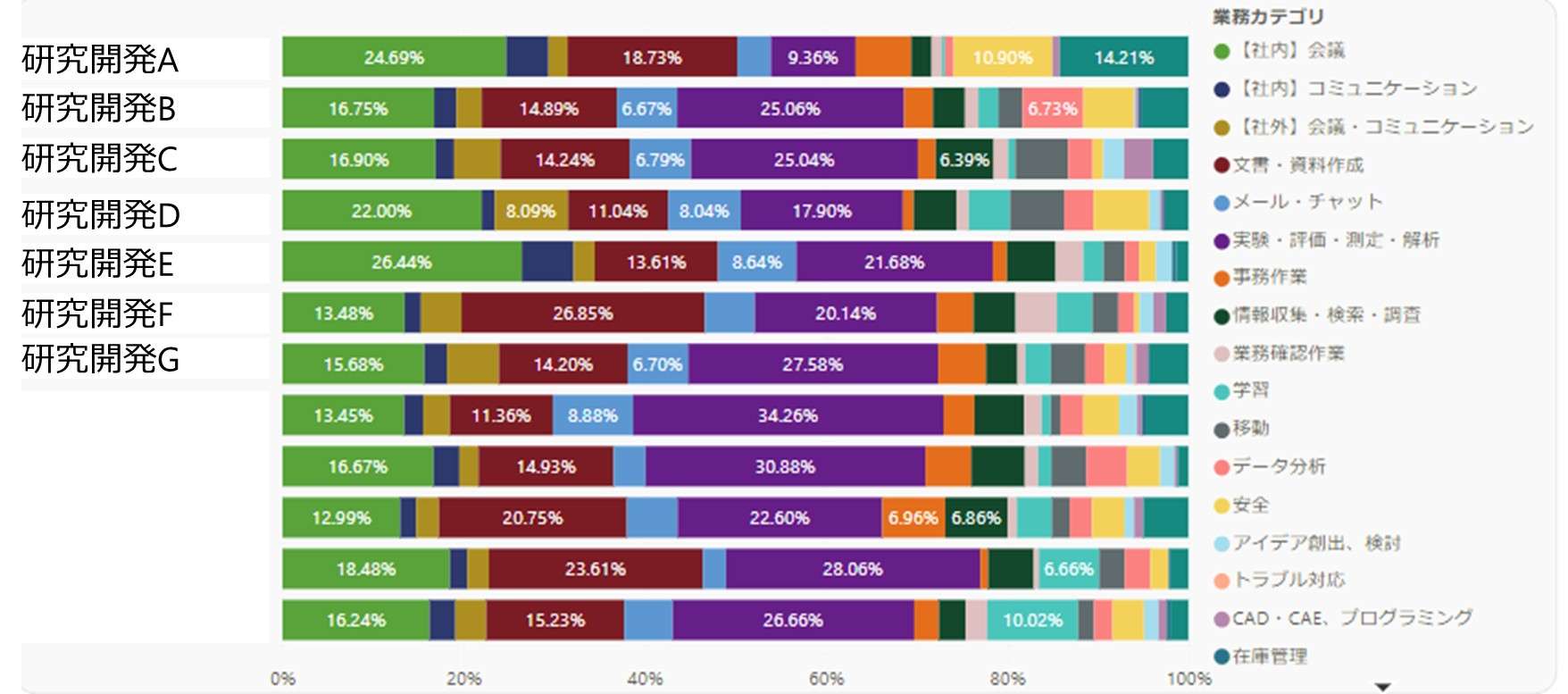

海外では、実験計画からデータ取得までを自動で回す仕組みが現実になりつつある一方、日本の研究開発は人手と時間の制約を前提に動かざるを得ない場面が多い。旭化成では研究開発メンバーが日々どの業務に時間を使っているかを把握できる形でデータを取得している。研究開発部署に限って集約した結果、実験・評価・測定に実際に使えている時間は約3割程度にとどまり、会議や文書作成が大きな比率を占める。

【図2-10】 研究開発の課題

【出典】 九十九委員提供資料。

こうした傾向は旭化成に限らず、多くのR&D組織、日本企業全体でも同様である。結果として、十分な試行回数を確保しづらく、探索が近い条件に寄りやすい構造が残りやすい。

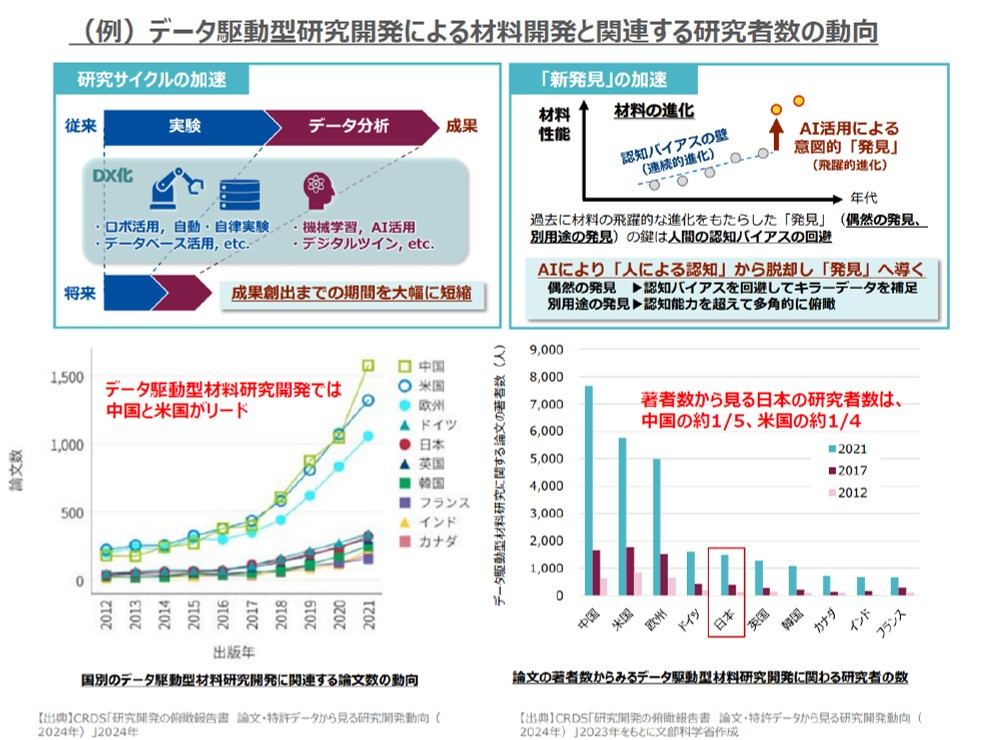

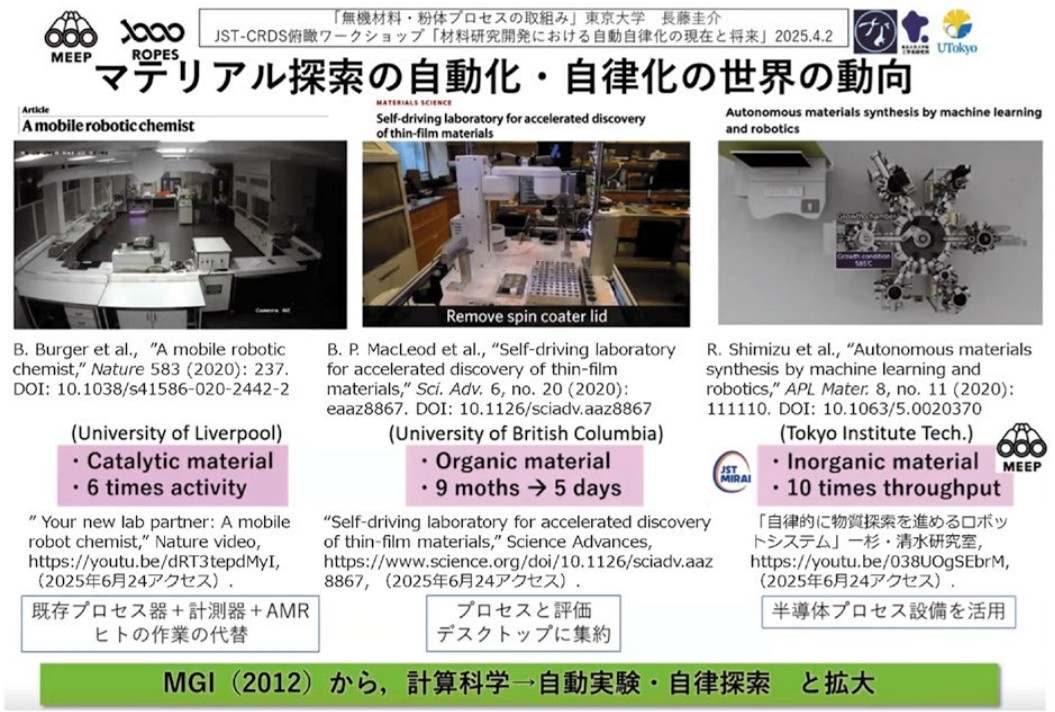

一方で海外では、材料条件や目標とする物性を入力すると、実験設備が立ち上がり、最適な実験計画をAIが算出して実行し、データ取得までを連続して進める体制が整いつつある。欧米や中国では2020年以降、「スマートラボ」と呼ばれる自動・自律実験の取組が進展しており、装置単体の自動化にとどまらず、計画から実行、データ取得までを一つの流れとして回す運用へ寄せている。カナダや英国では大型投資が進み、「スマートラボ」の整備を後押ししている。旭化成では、トロント側のチームに約800億円規模の資金投入があり、自動・自律実験の整備が進んでいる。Samsungでも自律実験のプラットフォームが整えられ、目的とする材料物性を起点に、計画から実行、データ取得までを連続させる方向で自動化が進む。

【図2-11】 データ駆動型研究開発の動向

【出典】 九十九委員提供資料 (科学技術・学術審議会 学術分科会(第94回)令和7年1月29日より)。

【図2-12】 マテリアル探索の自動化・自律化の動向

【出典】 九十九委員提供資料。

この差が開発速度に影響する理由は、試行回数の確保にある。人が実験する場合、時間の制約から近い条件の近傍しか試せず、試行回数が不足しやすい。しかし自動・自律実験によって試行回数を増やせると、探索範囲を広げ、競争力のある領域を狙いやすくなる。探索の運用としては、獲得関数の考え方に基づき、有望な領域の近傍探索を進めつつ、段階に応じて獲得値を調整し、遠方の領域も探索させるといった方針が置かれる。これを現実の設備運用に落とす際には、どの条件をどの順序で試し、どの設備をどう割り当てるかを決める実験スケジューリングが重要になる。計画は数理最適化の枠組みで扱い、制約条件の下で最適な組合せを算出し、実験全体の管理につなげていく。さらに、ロボット群が連続して実験を遂行し、デジタルツイン上で設備の動作や工程を再現しながら運用するイメージも含まれていた。フィジカルとエージェントを組み合わせ、段階的に自律化を進める方向である。

海外では、実験計画からデータ取得までを人の介在なしに回し、反復を増やして研究速度を高める取組が進む。一方、日本の平均的な研究開発では、会議や文書作成の比率が高く、実験に使える時間が限られ、試行回数を増やしにくい構造が残りやすい。研究開発の競争環境が厳しくなる中で、この差は開発速度の差として積み上がりやすく、危機感を共有した上で、どの工程から連続的な運用へ移すかを検討する必要がある。

2-2. AIエージェントの定義と活用場面における特徴

(1) AIエージェントの定義

本報告書では、AIエージェントを、「与えられた環境で複雑な目標を達成するために、新たな状況や想定外の状況に適応しつつ、次に取るべき行動を判断し、その判断に基づくタスクを限定的な人の介入の下で独立して実行するAI 」と捉える。

実際の活用では、観察に基づいて仮説を立て、評価検証を経て判断し、実行した結果を次の判断へ戻すという循環として整理できる。加えて、どこまでをAIが担い、どこから人が介入するかによって、自律性の程度は段階的に変化し得る。さらに、実行の対象が社内の情報処理にとどまる場合もあれば、設備などの物理系へ接続される場合や、社外の第三者とのやり取りに及ぶ場合もあり、対象範囲に応じて求められる設計や運用上の配慮も変化する。

AIエージェントという語は、提供者や文脈によって指す内容が異なり、統一的な定義やコンセンサスが必ずしも存在しない。説明のされ方としては、生成AIとの対比、単純タスクを行うエージェントの高度化、LLMによらない古典的従来型エージェント(図2-1参照)への生成AIの組込みなど、複数のパターンが混在し、これらを区別せず総称される場合も多い。

こうした用語の揺れと隣接概念を理解する上で、近年よく用いられる語として、エージェント型AI、マルチエージェントシステム(MAS)、フィジカルAIがある。

エージェント型AIは、英語のAgentic AIに対応する訳語として用いられることがあり、生成AIと対比して「生成する」だけでなく、「計画し、実行し、必要に応じて修正しながら進める」側面を強調する文脈で用いられることが多い。一方で、AIエージェントと対比して、より高度な自律性や協調まで含む概念として位置付ける場合もあれば、両者をほぼ同義として扱う場合もあり、同じ語でも「どこまでを指すか」が変わり得る点に注意が必要である。

また、マルチエージェントシステムは、複数のAIエージェントが協力して1つのタスクを進める仕組みを指す。単に役割分担して並列に作業するだけではなく、途中で相互に検証や修正を重ねながら、前提や方針のずれを揃え、結論の整合性を高めていく設計も含まれる。例えば、前節で触れたNTTのACT技術は、複数のエージェントが対話を通じて目的や解法をすり合わせ、最終的に一貫した成果へ収束させる枠組みとして位置付けられる。

さらに、フィジカルAIは、工場や倉庫などの現場でロボットや機器を安全に動かし、作業を遂行するAIや技術を指す意図で用いられることがある。現実の機器や環境を扱うため、制御や安全性、現場システムとの統合が重要になり、ロボティクスや自動運転を含む現実世界での認識・推論・制御を広く含めて語られることもある。

本報告書では、エージェント型AI、マルチエージェントシステム、フィジカルAIで語られる対象も含めて「AIエージェント」と呼ぶこととする。

そもそも、AI研究におけるエージェント概念は、人間や生物の行動を模倣する存在(「メタファー」)としての性格と「人の代理人」として社会的役割を担う存在との両義性が存在し、現在のAIエージェントはこの両義性を併せ持つため、同じ語であっても想定する役割や射程が異なる状況が生じる。

製造業における開発・設計から生産・販売というValue Chainの中での利用を想定する本報告書では、二元論ではなく、エージェント性の程度が異なるという連続性のあるものと捉え、議論を展開する。言わば、「人の代理人」との意に加え、デジタル化された職場の同僚という「メタファー」としての性格も加味されたものとなる。

(参考)AI事業者ガイドラインとしての定義(経済産業省、総務省)

2026年3月31日公開 総務省、経済産業省「AI事業者ガイドライン(第1.2版)」本編より引用

・ AIエージェントの定義

本ガイドラインにおける AI エージェントとは、特定の目標を達成するために、環境を感知し自律的に行動する AI システムとする。

(参考として ISO/IEC 22989:2022 では、以下のように定義されている)

自動化された主体であり、環境を感知して応答し、自らの目標を達成するために行動を取るもの

・ フィジカルAIの定義

本ガイドラインにおけるフィジカル AI とは、センサ等によるセンシングを通じて物理環境の情報を取り込み、AI モデルによる処理を経て、設定された目的を達成するための最適な方策を自律的に推論・判断し、アクチュエータ(駆動系)等を介して物理的な行動へとつなげるシステムであり、サイバー空間での処理に留まらず、現実世界に対して直接的な働きかけ(移動、操作、加工など)を行うことを特徴とするものとする。

(2) AIエージェントの活用場面における特徴

AIエージェントの最大の特徴は、目標達成のために自ら考え、計画し、行動するという高い自律性を具備し、目標達成まで連続的に複数のタスクをこなす点にある。LLMによらない古典的従来型エージェントは、指示に基づくコンテンツ作成を中心とし、基本的には利用者の指示を起点に応答する。一方、RPA11や製造ロボットは、あらかじめ定められた手順に基づく定型作業を実行することに強みがある。

これらに対し、LLMエージェント(図2-2参照)としてのAIエージェントは、目標を与えられた際に、必要な作業を分解し、順序を組み立て、実行までを担う存在として位置付けられる。しかし、AIエージェントは目標達成まで複数のタスクを連続的にこなすために、実行過程での分岐や試行が増え易く、不確実性が大きくなり易く、その結果確実性や再現性が低下し得るという制約も存在する。とりわけ自律的に連続作業を行う場合には、不確実性が増大し得る点に留意を要する。これに対し、RPAや製造ロボットは、定型作業を確実に反復しやすく、再現性が高いという性格を持つ。

加えて、製造業における開発や生産プロセスでは、外部世界を観察し、判断し、働きかけるという行為能力が欠かせない。ここでいう外部世界には、物理的環境だけでなく、情報やデータも含まれる。AIエージェントはそれらを踏まえて推論し、判断し、次の行動に移す主体として理解される。

11 RPA(Robotic Process Automation):PC上の定型的な事務作業などを、あらかじめ定めた手順に従って自動実行する仕組み。

2-3. 本フォーラムでの検討スコープ

(1) 検討の視点

AIエージェントは、作業時間の短縮などの効率化や、人間では不可能な作業精度の達成に加え、新たな価値の創出も期待される。一方で、目標達成まで複数のタスクを連続的にこなす性格を持つため、実行過程が複雑化し、不確実性が大きくなり、再現性が低下し得るという固有のリスクも併せ持つ。このため、限定的な人の介在という状況で作動するAIエージェントの特性を踏まえ、どの業務をどこまで代理させるか、また人がどの程度介在するか、すなわち「自律性の程度に着目した検討」が必要となる。

また、製造業での利用を想定すると、AIエージェントが扱う対象は情報やデータにとどまらず、実物の設備や製品を含む物理世界に及ぶ。したがって、「物理世界との関係、または物理系との接続を視野に入れた検討」が欠かせない。さらに、「高い自律性」と「物理系との接続」は、社内に閉じた影響にとどまらず、社外の第三者との関係において問題を惹起する可能性がある。特にその場合、法的責任の所在や考え方も重要な検討事項となる。

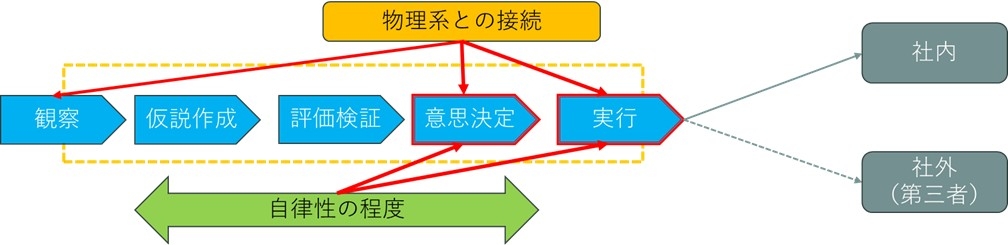

AIエージェントを用いた仕事の流れは、観察、仮説作成、評価検証、意思決定、実行という工程で捉えることができ、どの工程をどの程度AIエージェントに担わせるかにより自律性の程度が変化し得る。また、実行段階に近づくほど物理系との接続や対外的な影響が生じ得る(【図2-13】参照)。

【図2-13】AIエージェントを用いた仕事の流れ

【出典】 フォーラム委員会の場での検討に基づき、事務局において作成。

(2) 検討する立場

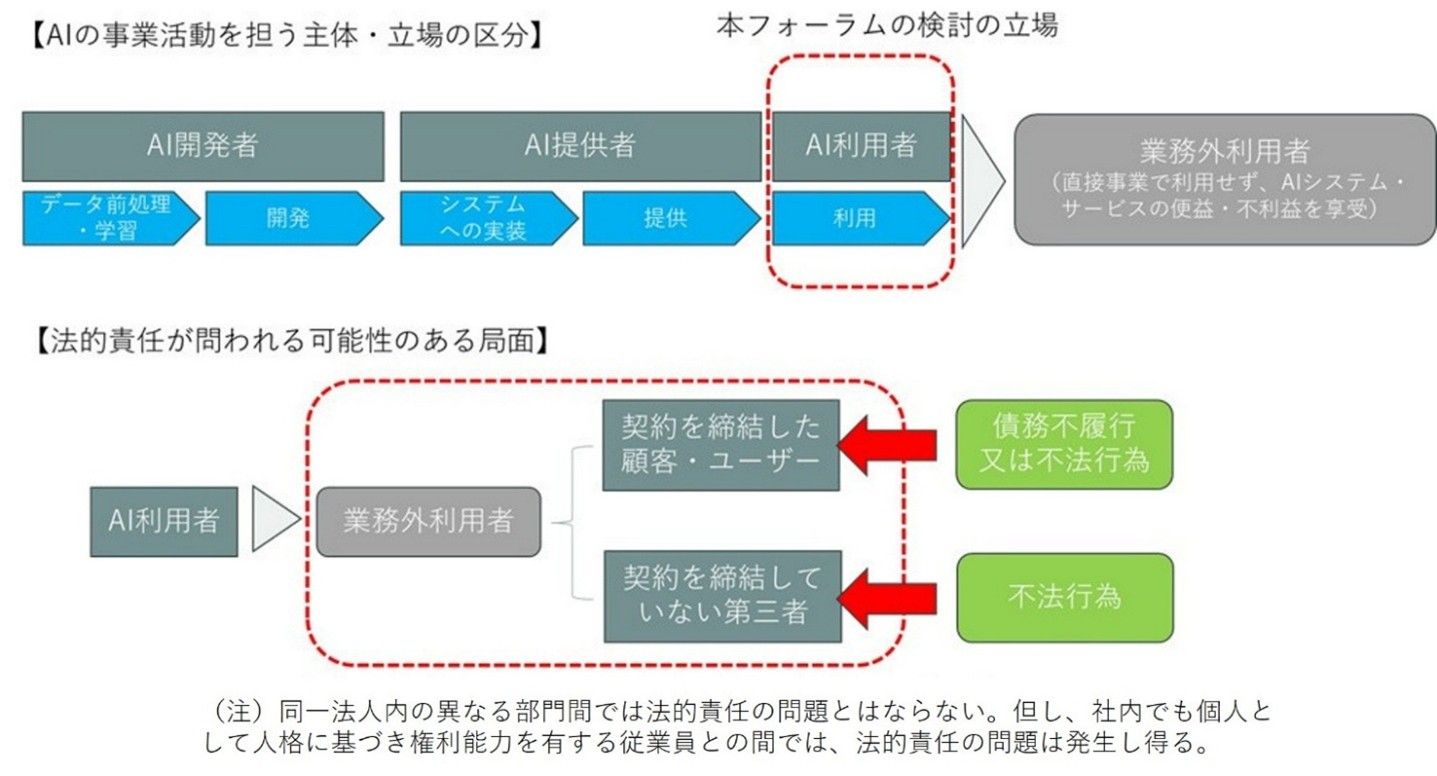

経済産業省及び総務省が2025年3月28日に公表した「AI事業者ガイドライン(第1.1版)」では、AIの事業活動を担う主体を「AI開発者」「AI提供者」「AI利用者」に区分しており、「AI利用者」は「事業活動において、AIシステムまたはAIサービスを利用する事業者」と定義されている。また、事業活動ではなくAIを利用する「業務外利用者12」についても説明されている。

製造業において期待されるAIエージェントの活用を検討する本フォーラムでは、自らの事業活動においてAIエージェントを利用することに主眼を置き、AI利用者としての立場から論点を整理し、課題を抽出する。整理の観点は、①利用上の留意点(自律性と物理系との関係の2軸で整理)と、②導入に向けた準備(基盤整備)および解決すべき技術的・制度的課題、の2点である。これらは、AI開発者・AI提供者の立場からの整理とは相違し得る。本フォーラムの立場と、AI開発者・AI提供者との関係及び業務外利用者を含め社外との関係の位置づけを【図2-14】に示す。

ただし、同一事業者であっても、部門によってはAI開発者やAI提供者の立場となり得る。また、社外のAI開発者やAIプロバイダーを活用する場合もある。本フォーラムでは、同一法人内(社内)に影響が留まる場面を主たる出発点として、まずAI利用者の立場から検討・整理する。その上で、必要があれば、社内における「開発者」「提供者」と「利用者」との関係についても検討・整理する。

また、AIエージェントを事業活動で利用し、社外の第三者に影響が及ぶ場合には、その内容も併せて検討する。特に、AIエージェントを活用した製造業者が、顧客・ユーザー等の社外の第三者に影響を与えた場合に、法的責任が生じ得ることを念頭に置く(【図2-14】参照)。

【図2-14】AI利用者の立場と社外との関係

【出典】 経済産業省・総務省 「AI事業者ガイドライン(第1.1版)本編」(https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/20240419_report.html)を参考にして、事務局において作成。

12 業務外利用者:事業活動以外でAIを利用する者、またはAIを直接事業で利用せずにAIシステム・サービスの便益を享受する、場合によっては損失を被る者と説明されている。なお、同ガイドラインは、事業活動においてAIの開発・提供・利用を担う者から業務外利用者への必要な対応は記載されているものの、業務外利用者を同ガイドラインの対象には含んでいない。(経済産業省・総務省 「AI事業者ガイドライン(第1.1版)本編」https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/20240419_report.html)

第3章 AIエージェントの活用が期待される分野と配慮すべき点

本章では、製造業におけるAIエージェントの利活用について、期待される効果と、活用を進める上で配慮すべき点を整理する。具体的には、開発設計、生産、サプライチェーンマネジメント、間接業務といった主要な業務領域を対象に、AIエージェントの活用がどのような成果につながり得るかを概観する。その上で、AIエージェントの特徴である自律性や、物理系との接続を伴う利用を念頭に置き、利活用に際して生じ得る懸念点と、それらを低減するために検討すべき対策の方向性を示す。

3-1. AIエージェントの活用が期待される分野とその効果

(1) AIエージェントの特長と限界(制約)

前章で述べたとおり、AI研究におけるエージェント概念には、人間や生物の行動を模倣する存在という「メタファー」としての性格と、「人の代理人」として社会的役割を担う存在という性格がある。例えば、初期は人の横で情報収集や整理を進める「デジタル化された職場の同僚」のように動き、手順や判断の型が固まった部分では、人の代わりに実行する「人の代理人」のように動く。支援から代行へと役割が自然に移る点が特徴である。

この前提に立つと、AIエージェントの特長としてまず挙げられるのは、人と連携しながら仕事を進められる点である。人の意図や指示を受け取りながら、必要な情報を参照し、途中経過を更新して次の作業へつなげる動きが取りやすい。あわせて、既存の業務システムやデータ基盤をすべて置き換えるのではなく、共存させたまま運用の中に組み込みやすい。さらに、休まず動く働き手として継続的に支える使い方が可能であり、処理を並行に走らせるなど必要に応じて拡張できる点も大きい。適用先も特定の領域に閉じず、あらゆる分野・幅広い業務に展開し得る汎用性がある。

ただし、限界と制約も押さえておく必要がある。AIエージェントは柔軟に見える一方で、任せる範囲と人が判断する境界を決めないと運用が安定しにくい。また、入力データや社内ルールの整備状況に強く依存するため、根拠が薄い出力や揺れが生じ得る。加えて、情報管理や安全面の条件を満たす設計が欠かせない。

(2) 分野毎の活用事例と期待される効果

本項では、AIエージェントの活用が期待される分野を、①開発設計分野、②生産分野、③サプライチェーンマネジメント(SCM)13分野、④間接業務分野に整理し、本フォーラム委員から寄せられた活用が期待される事例とその効果を示す。併せて、これらの分野において既にAIエージェントが活用されている事例を、巻末に [Appendix 3] として紹介しているので、参照していただきたい。

13 SCM(Supply Chain Management):需要予測を踏まえたPSI(生産・販売・在庫)管理、調達・生産・販売計画の最適化などを含む、開発から生産・販売・納入までの一連の流れを一貫して最適化・管理する考え方。

① 開発設計分野

開発設計分野では、設計の自動化(「過去トラ」14の分析や設計書の自動作成)、自律的な自動実験、シミュレーション(実験装置や実験環境の自動制御、自律的なデータ取得)での活用が期待される。さらに、特許出願支援での活用も想定される。

期待される効果としては、設計時間の短縮、手戻り削減、人による設計品質の差異解消、市場への上市の迅速化が挙げられる。特許出願支援については、特許審査通過率の向上等を通じた権利化の迅速化や、競合他社に対する技術優位性確保が挙げられる。この他、人の経験・発想に捕らわれない斬新なアイデアの創造等、新たな価値の創出につながるとの指摘もある。

AI固有のリスクとしてよく挙げられるハルシネーション15については、「研究開発段階においてはハルシネーションが思いがけない発見を産む。」とのフォーラム委員からの意見があり、また、一つのAIエージェントよりもマルチAIエージェント16を使用する方が多様な意見が出現し、創造性が高まるとの指摘も出された。

14過去に起きたトラブルを収集したもの。

15 ハルシネーション:LLM等が、事実に基づかない(もっともらしい)内容を生成する現象。

16 マルチAIエージェント:複数のAIエージェントが役割分担・連携してタスクを解く構成。単一エージェントより多様な観点が得られ、全体の成果の質向上が期待される。

② 生産分野

生産分野では、工場やライン毎から全社レベルまでの最適生産計画の策定、エネルギー消費の管理・制御、生産工程の管理・制御の自律化(設備の自動制御、プロセス最適化、異常値通知と対策提案)といった用途が挙げられる。さらに、プログラム・経路生成ロボットや工場内作業を状況に応じた判断を伴って実行するヒューマノイド・ロボットという究極の生産の自律化まで、多様な段階・バリエーションが存在する。

品質管理の観点では、過去トラ分析等の品質管理システムでの活用や、自律的な外観検査による不良品流出防止での活用が期待される。その他、24時間運転の現場において、夜間や海外拠点との時差があっても、問い合わせ対応や作業判断をサポートする現場支援メタバース、業務教育を行う寄添いガイド、技術・技能伝承での活用も期待される。

期待される効果としては、熟練工等の人手不足解消のための省人化、品質の安定確保、人手による工程間のバラツキ解消や生産計画でのヒューマンエラーの撲滅、リードタイムの短縮、顧客への納期遵守率向上等による生産性向上が挙げられる。加えて、危険作業の代替や、通常の管理・監視業務(現場教育も含む)からの解放を通じて、人間に期待される本来業務への回帰も見込まれる。

③ サプライチェーンマネジメント(SCM)分野

サプライチェーンマネジメント(SCM)分野では、需要予測を踏まえた自律的なPSI17(生産・販売・在庫)管理と生産・販売計画の最適化、PSI情報や案件の確度に応じた部材調達発注の自律化、受注引合への自律的回答、商談資料の自動作成等の営業支援が挙げられる。開発から生産・販売・納入までに至る一貫したSCMでの活用も期待される。

期待される効果としては、属人化の防止や負荷・工数の削減、在庫削減をはじめとするサプライチェーン全体の最適化による利益最大化が挙げられる。加えて、機会利益逸失の防止や競争力強化等による企業価値の向上を効果として挙げるフォーラム委員らの意見もあった。

17PSI:生産(Production)・販売(Sales)・在庫(Inventory)の3つの情報を統合し、需給の整合を取りながら生産計画や在庫水準を管理する枠組み。

④ 間接業務分野

間接業務分野では、内外の情報を統合した中期事業計画、事業戦略、新規事業戦略、M&A戦略等の各種経営戦略の策定支援から、ITシステム開発やコーディング等のプログラム開発、調査・レポーティング・文書化、会議スケジュールの調整や舵取り、議事録作成に至るまで、幅広い分野での活用が期待できる。加えて、各種の社内手続き(休暇申請、育休申請をはじめとする人事手続き、スキル審査、人事異動時の引継資料作成等)や、契約書作成を含めた契約管理での活用も挙げられる。地方自治体を含めた環境規制の情報を把握し、必要な届出を含む規制対応を行うとのアイデアもある。

期待される効果としては、人間の経験・発想による部分的な情報を超えた判断が可能となることに加え、事務の効率化、人為的なミスの回避と質の向上が挙げられる。環境規制対応支援での活用では、コンプライアンスの充実強化や事故防止の効果も期待される。

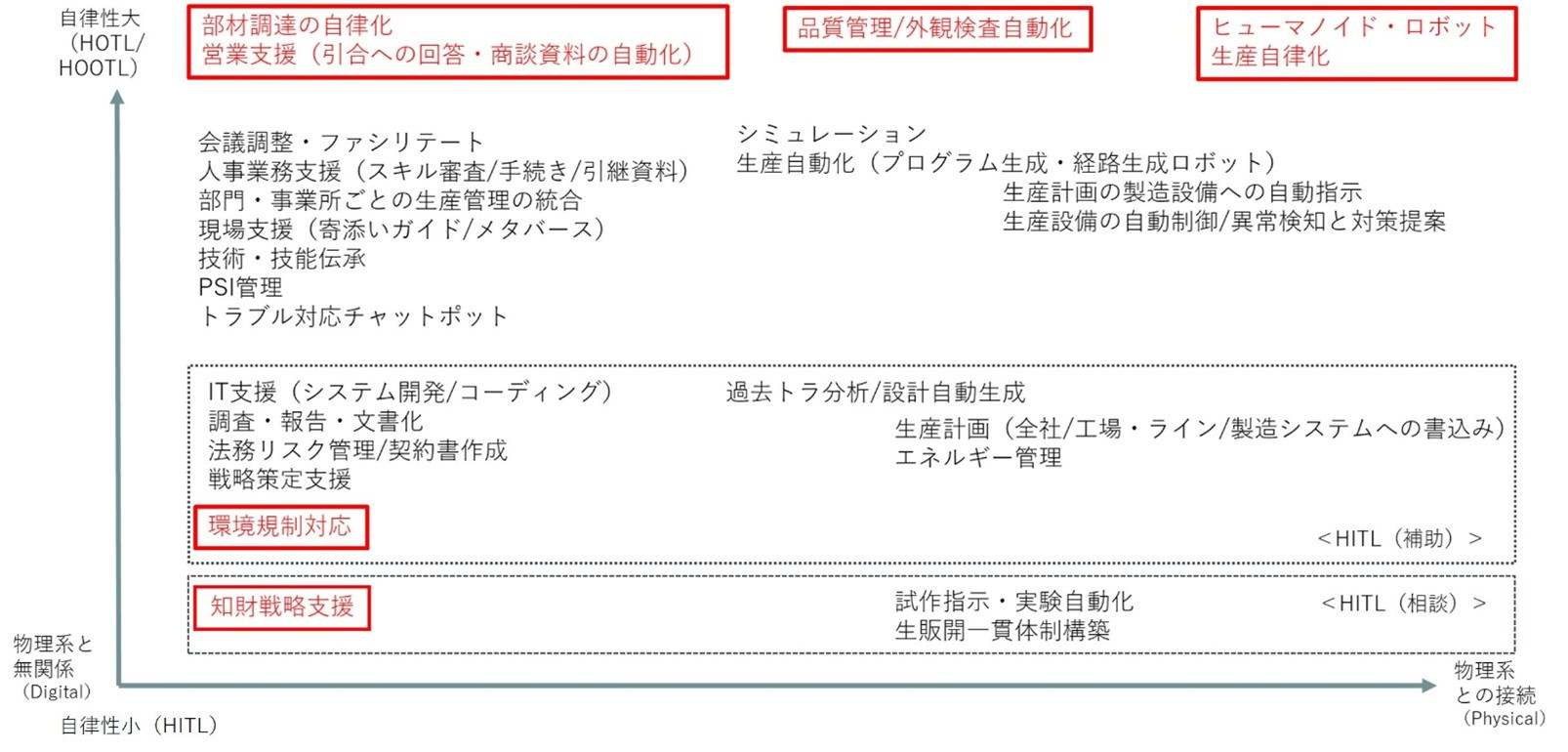

(3) 人の介在の度合い(自律性の程度)と物理系との接続の概観

AIエージェントの活用事例を、自律性の程度と物理系との接続の有無という2つの観点から概観する。

第4章において採り上げる自律性の観点からは、AIエージェントにどこまで判断や実行を任せ、どの段階で人が関与するかが重要となる。運用は、人の判断や承認を前提とするHITL(Human-in-the-Loop)、または人が監視し必要時に介入するHOTL(Human-on-the-Loop)が中心であり、人の介在なしに一連のプロセスを自律的に実施するHOOTL(Human-out-of-the-Loop)は限定的である。

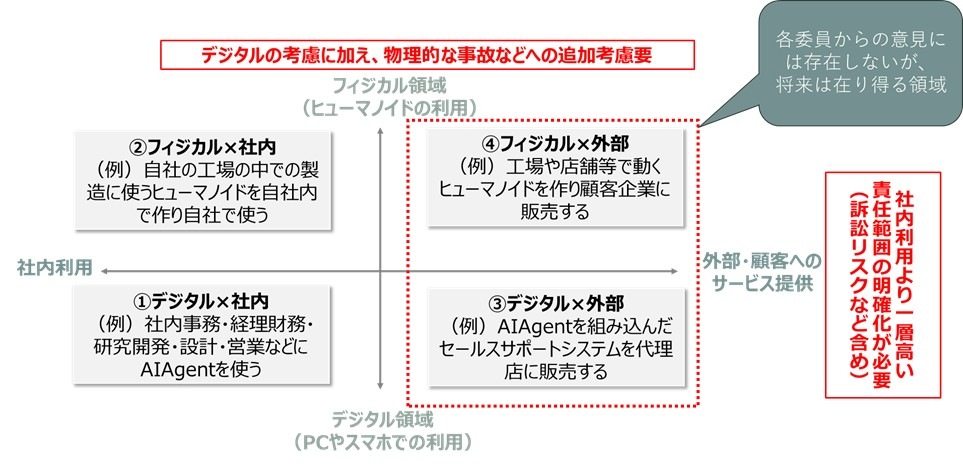

次に、第5章において採り上げる物理系との接続の観点では、開発設計分野や生産分野において、実験装置、生産設備、ロボットなどの実機と接続し、制御を含む形で物理世界に作用する活用が想定されている(【図3-1】参照)。一方、SCM分野や間接業務分野では、情報やデータの取り扱いを中心とし、物理系と直接接続しない形での活用が中心となる。

また、現状では、AIエージェントを社内で利用することを念頭に置いて検討されており、各種業務分野で成功したAIエージェント活用のシステムやサービスを社外に提供するとの計画は示されていない。したがって、本章での整理は、事業活動においてAIエージェントを利用するAI利用者としての立場に基づく(【図3-2】参照)。

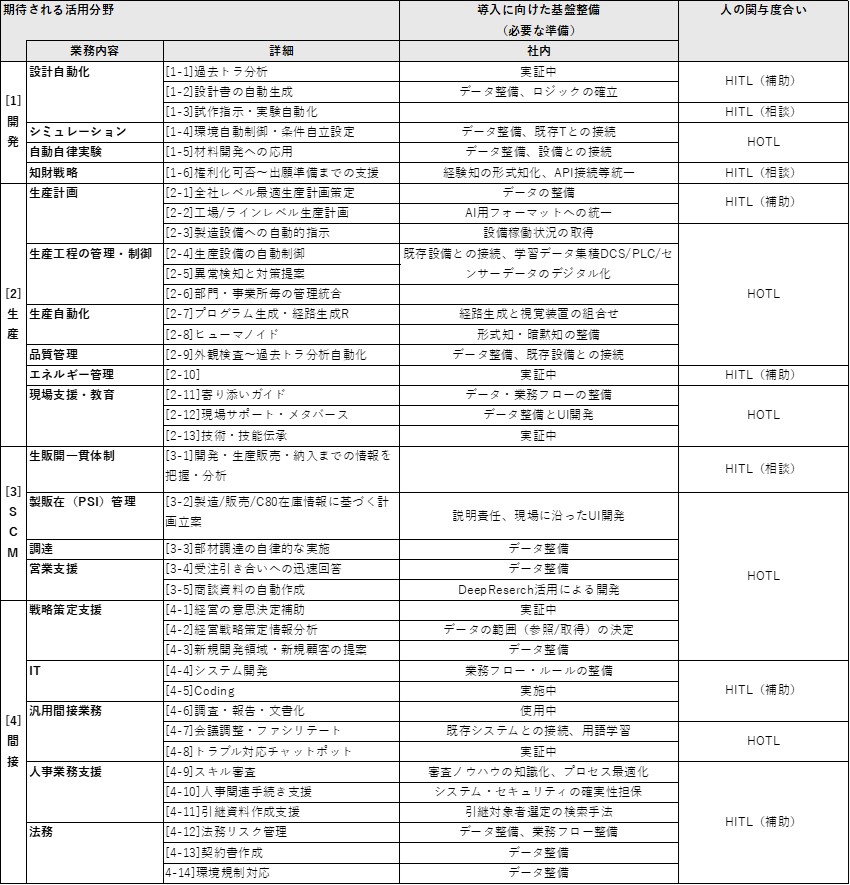

第7章において採り上げる導入に向けた準備(基盤整備)としては、データ不足、ナレッジ蓄積不足の解消が挙げられている。あわせて、解決すべき課題として、安全性・信頼性の確保のほか、実機との接続プロトコルやAPIの標準化等の技術的課題、AI利用者として顧客等への説明責任を果たすルール整備等の制度的な課題も挙げられている(【表3-1】参照)。

【図3-1】AIエージェントの活用が期待できる分野(各委員からの意見集約)

【出典】 フォーラム委員会の場での検討に基づき、事務局が作成。

【図3-2】社内利用と社外への提供の区分

【出典】 荏原製作所 田中委員の提出資料に基づき、事務局が作成。

【表3-1】 AIエージェントの活用事例(活用場面と検討課題など)

①期待される活用分野、基盤整備、人の関与度合い

②利用上の課題・留意点(物理系との関係、技術的・制度的課題)

【出典】 フォーラム委員会の場での検討に基づき、事務局において作成。

3-2. AI エージェントの活用における配慮すべき点

(1) AIエージェントの活用に関する限界・制約

AIエージェントは、その利活用により様々な効果と多大な効用が期待される一方で、社会の中に心配や懸念の声が存在することも事実である。こうした心配や懸念の声は、AI エージェントが有する限界または制約として、正確に認識しておくことが必要である。AIエージェントを、期待される効果を発揮させるよう有効に活用していくには、懸念点を解消または減少させる取組が重要となる。ただし、現状のAIエージェントを静態的に理解するのは避けるべきである。継続的に学習し改善していくAIエージェントは、技術の進歩と相まって、成長するという特性を持つ。AIエージェントの成長とともに、その利活用を拡大するとの動態的な姿勢が重要と思われる。

我々は、「たとえ優秀な新入社員であっても(優秀な社員ほど)、手本を示し、やらせてみて、アドバイスを与えないと育たない。」という教訓に慣れ親しんでいる。優秀な新入社員に例えられるAIエージェントに対しても、この教訓が有効であることに我々は思いを馳せるべきである。 本報告書では、製造業での活用を検討する上で論点となりやすい懸念を、次の5点に整理する。

① 不確実性の低減

AIエージェントは複数のタスクを連続実行しながら判断を積み重ねるため、推論経緯が追えない運用では、想定外の挙動が起きた際に原因特定や是正、説明が難しくなり得る。特に、多段推論18と可観測性の不足により、どの情報や判断が結果に影響したのかが不透明化し、誤りの検出遅れや影響の拡大につながるおそれがある。さらに、長期記憶の反復利用では悪意ある指示の混入や未更新情報の参照により意図しない挙動が固定化し得るほか、同一入力でも出力が揺らぐことやモデル更新で挙動が変わることなど、モデル自体の不確実性も残る。加えて、マルチエージェント協調では更新頻度が異なる複数のエージェント間での相互作用などにより意図しない合意形成や逸脱が起こり、責任の所在が曖昧になりかねない。

フォーラム委員からは、学習・参照情報を増やすほど常に精度が上がるとは限らず、情報の質が低い場合や、参照の与え方または運用設計が不適切な場合には、誤りの混入や見逃しが増え、結果として出力の不確実性が高まるおそれがあるとの指摘がなされた。したがって、単一のエージェントに大量の学習をさせるのではなく、それぞれに小さな役割を持たせて、量と品質のバランスを取るというアプローチが有効との意見が挙がった。また、チェック役エージェントや別系統の検証手段を用意する必要もあり、単一エージェントで完結させるのではなく、用途別に分担させる設計や検証機構を含む運用設計のバランスを取る必要があると思われる。

加えて、製造業で扱われる業務データは表形式・数値データを含む場合が多く、意図した理解や生成が難しくなり得る。参照データの与え方、チューニング、業務に即したデータ整備、要求水準に応じた運用設計の差が、出力品質のばらつきとして現れ得るという意見がフォーラム委員から挙がった。

18 多段推論:タスクを小さな判断・処理に分解し、複数の推論ステップを順に積み重ねて結論や行動に至る推論。ステップ数が増えるほど、どの判断が結果に影響したかの追跡が難しくなり、推論経緯の記録や可視化が不十分な場合は原因特定や再発防止が困難になり得る。

② 権限配分の明確化

AIエージェントの特徴である外部連携と権限昇格への対応が問題となる。付与権限の設計次第で、意図しない外部操作や不適切な処理が生じ得るほか、マルチエージェント協調や相互作用の結果として生じる想定外の逸脱が加わると、行為の連鎖が複雑化し責任の所在が不明確になり得る。また、単一エージェントで完結させるのではなく用途別に分担させる構成では、処理の分散に伴い、権限や責任の分界が見えにくくなる可能性がある。

③ 自律性許容範囲の設定

AIエージェントの高い処理能力に依存する結果、本来は人が担うべき重要な意思決定まで委ねてしまうおそれがある。また、利便性が高いがゆえに、判断・調整・学習といった人的能力の成長機会を逸失させることも想定される。

④ 物理系接続リスクの管理

AIエージェントの判断が実機制御等を通じて物理世界に作用し得る場合、ソフトウェア内で完結する場合とは異なり、影響が即時に広がり得る。したがって、物理系との接続を固有の論点として切り分け、安全性・信頼性の確保や段階的導入の設計を前提に検討する必要がある。さらに、物理系との接続に踏み込む際には、サイバー側で扱う範囲と物理側の制御・安全設計として扱う範囲を切り分ける必要がある。物理現象の理解や現場制約を前提に、ソフトウェア中心の整理とは別枠で検討される領域が残り得る。

また、物理領域へのAIエージェント導入の初期段階では生産性が下がり得ることや、導入効果の現れ方が時間軸によって異なり得ることから投資判断や評価が難しくなり、成果が見えにくくなるとのリスクがフォーラム委員らから指摘された。こうした低評価や批判の惹起の可能性も踏まえ、予め、導入の優先順位の高い領域を明確化し、実証・展開の時間軸を示すスケジュールの見える化が必要となろう。

⑤ 第三者権利侵害リスクと責任整理

AIエージェントを事業活動で利用し、第三者に影響が及ぶ場合には、権利侵害のおそれが生じ得る。権利侵害リスクの低減に加え、発生時に備えた責任の所在、説明、対応の在り方をあわせて検討することが必要となる。

(2) リスク低減に向け検討すべき考え得る対策

前項で整理した5つの懸念のうち、①不確実性の低減と②権限配分の明確化は、利用分野を問わずAIエージェントに内在しやすい課題である。本項では、両者について要因と対策の方向性を示す。

なお、③自律性許容範囲の設定は第4章、④物理系接続リスクの管理は第5章、⑤第三者権利侵害リスクと責任整理は第6章で扱う。

① 不確実性の低減

不確実性を低減するには、まず不確実性の要因を分解した上で、それぞれに対応する記録・検知・検証・運用管理の対策を組み合わせて講じる必要がある。主な要因と、対策の方向性は次のとおりである。

a) 多段推論と可観測性の不足:推論経緯とトランザクションIDを記録し、参照データや外部ツール呼び出し履歴まで紐付けて原因解析を可能にする。

b) 長期記憶と記憶改ざん:プロンプトインジェクション19の検出と制御に加え、記憶の書込み条件や参照元の管理、更新期限の付与などで汚染を抑える。

c) マルチエージェント協調と創発的共謀:監査可能なログを記録し、チェック工程の組込みや人的介入の条件定義により逸脱時の抑止と停止を行えるようにする。

d) モデル(LLM)自体の不確実性:モデルの版管理と更新手順、更新前後の回帰評価20、業務別の受入基準の設定により、挙動変化を管理する。

19プロンプトインジェクション:入力文や参照文書の中に指示文を紛れ込ませ、AIに意図しない操作や情報参照、ルール逸脱を起こさせる攻撃。

20 回帰評価:モデル更新の前後で同一の入力を与え、出力や判断が想定外に変化していないかを確認する評価(回帰テスト)。

② 権限配分の明確化

外部連携を伴う場合、権限逸脱や責任の曖昧化を防ぐため、権限設計と証跡を一体で整備する必要がある。具体的には、権限の最小化と段階的付与、コマンド履歴の記録、受領側の真正性確認やなりすまし対策を講じ、権限の範囲と責任の境界を運用として固定することが重要となる。

第4章 自律性の許容範囲(人の介在の程度)に関する考察

本章では、前章の内容を踏まえ、製造業の開発・生産等のプロセスにおけるAIエージェントの導入・運用に際して、人がどの程度介在すべきか、すなわち自律性をどこまで許容するかを整理する。自律性を人の介在の程度に応じて類型化した上で、本報告書における用語の扱いを明確にする。次に、当該業務で許容できるリスクの程度に応じて自律性の許容範囲を段階的に設定する考え方を示し、最後に、社内外への説明責任を果たすための方策を整理する。

4-1. 自律性の類型

AIエージェントの自律性は、人の介在の程度に応じて類型化して説明されることが多い。代表的な区分は次の通りである。

① HITL(Human-in-the-Loop):人が常時介入する

② HITLFE(HITL for Exceptions):通常は自動で処理し、例外時に人が介入する

③ HOTL(Human-on-the-Loop):人が監督者として待機し、必要に応じて介入する

④ HOOTL(Human-out-of-the-Loop):人の介在なしに実行される

これら以外にも、人が指揮権を持つという観点からHIC(Human in Command)という類型が言及される場合がある。

本報告書では、自律性の程度に応じた分類を精緻に定義し直す作業には踏み込まず、人の介在の程度、すなわち自律性の許容度の大小に着目して、HITLとHOTLを中心に扱うこととする。

まず、HITLとHITLFEを厳密に区別することはせず、最終的には必ず人が判断する運用を指すものとして扱う。さらにHITLについては、次の2つの類型を用意する。

- HITL(補助):AIエージェントを補助として用い、人の判断の下調べとして知識収集を担わせる。

- HITL(相談):AIエージェントと人が常時対話しつつ、人が判断を形成することを支援する。

前者のHITL(補助)はAI エージェントにそれほど自律性を与えず、生成AIに近いものとして利用する形態を念頭に置く。他方、後者のHITL (補助)は、AIエージェントにある程度の自律的な行動を許すが、必ず最終判断を人が行う類型である。

次に、HOTLは、必要時には人が介在する余地を残した運用を指すものとして扱う。すなわち、監督待機の下でAIエージェントが自律的に実施する場合に加え、人の介在なしに実行される形態も視野に入れつつ、同一の整理枠の中で検討する。完全な自律性を許容するHOOTLも、このHOTLの延長上にあり、自律性の許容度が最大となるものとして扱う。

4-2. 自律性の許容範囲の考え方

業務で利用するAIエージェントについては、当該業務において許容できるリスクの程度に応じて、人の介在の程度を変化させるという考え方を採用する。すなわち、同じAIエージェントであっても、扱う業務の性質や影響範囲に応じて、HITLを基本とするのか、HOTLを基本とするのかを選択し、必要に応じて自律性の許容範囲を調整する。

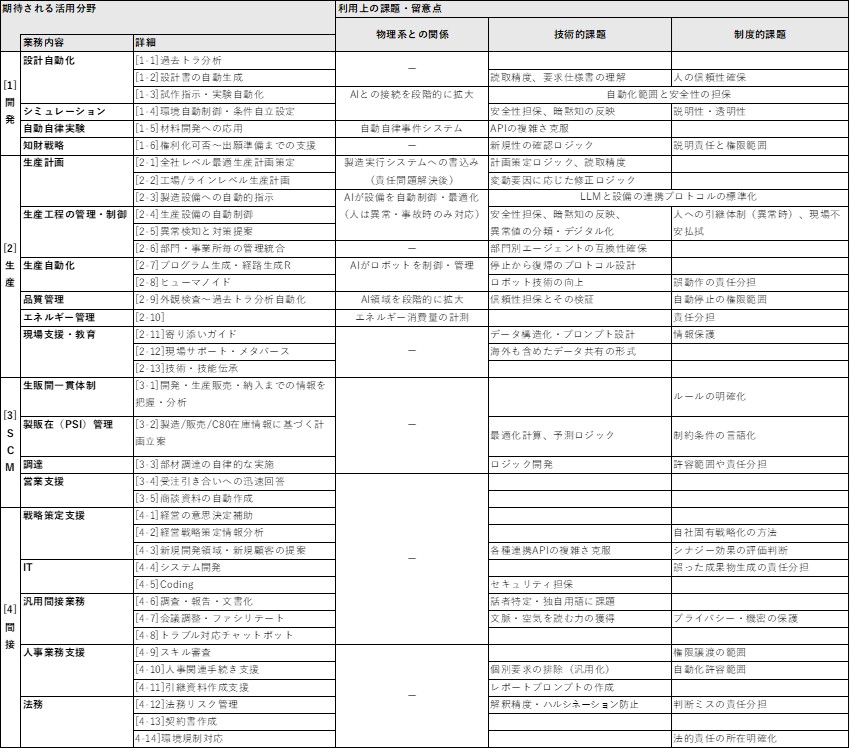

自律性の許容範囲を、具体的に次の4段階で整理する(【図4-1】参照)。

(1) 人間判断型:HITL(補助)

人による法的・経営的・倫理的判断を必須とする領域を対象とし、AIエージェントは判断の材料収集や整理などを担う。

人間の創造性や感情表現が必要とされるタスクには、現在のAIエージェントは適さないとされるためである。また、より広範囲な社会環境の理解や不完全な情報下で判断が求められる戦略的な意思決定は、高度な推論や社会を見抜く直観力を欠くというAIエージェントの限界・制約が存在するとされる。

業務領域の例として、人事の最終決定(評価、採用、解雇、懲戒処分)、経営判断(中長期計画、投資判断、M&A等)が挙げられる。

(2) 人間介在型:HITL(相談)

AIエージェントの提案・支援を受けつつ、人が最終承認する。

業務領域の例として、生産計画策定支援、設計、商談資料・契約書の自動生成、IT支援、試作指示、知財出願、環境規制対応、部材調達の自動化等が挙げられる。

(3) 原則自律型:HOTL

AIエージェントが自律的に実施し、過程・結果を人が監視する。異常時には人が介入する前提で運用する。

業務領域の例として、発注書と請求書の記載内容が一致しているかを確認する一次照合、一定範囲内のPSI管理、品質管理、外観検査、シミュレーション、生産自動化(自動制御)等が挙げられる。

(4) 完全自律型:HOOTL

人の介在なしに、AIエージェントがE2E21のプロセスを自律的に実施する。

業務領域の例として、会議スケジュール調整、トラブル対応チャットボット(一次問い合わせ)、人事関連手続(引継、スキル審査)、寄り添いガイド等が挙げられる。

21E2E(End-to-End):工程や業務の「端から端まで」を一貫してつなぎ、全体最適の観点で設計・運用すること(例:需要予測→調達→生産→物流→販売までを一気通貫で管理する)。

【図4-1】自律性の許容範囲の考え方

【出典】 フォーラム委員会の場での検討に基づき、事務局が作成。

人の関与の度合いと自律性の捉え方については、国際機関が示す枠組みも参考になる。OECD22は、AIシステムを比較しやすい形で説明するための分類枠組みを提示しており、その中でAIモデルの捉え方と、自律性の段階的整理を示している。

OECDではAIモデルを、AIシステムが置かれた外部環境の全部または一部を表す表現として位置付ける。外部環境には、業務の流れや対象物、人、相互作用などが含まれ得る。AIモデルは、データや人が与える知識を用いて、現実または仮想の環境を表現し、記述し、やり取りするものと整理されている。

その上で、自律性は、推論結果に基づく行為がどの程度、人の関与なしに実行されるかで4段階に整理されている。具体的には、AIは、「提案や出力を示すだけで実行しない段階」、「人の同意がある場合にのみ実行する段階」、「人が拒否しない限り実行する段階」、「人の関与なしに実行する段階」である。こうした整理は、HITL、HOTL、HOOTLの考え方を補足する際の参照として用いることができる。23

22 OECD(Organisation for Economic Co-operation and Development):経済協力開発機構。ヨーロッパ諸国を中心に日・米を含め38ヶ国の先進国が加盟する国際機関。

23OECD, 2022, OECD Framework for the Classification of AI Systems, OECD Digital Economy Papers, No.323.

【解説】 OECDにおけるAIモデル定義と自律性分類

(1) OECDのAI分類フレームワークとは

OECDのAI分類フレームワークは、AIシステムを比較可能な形で記述し、政策・ガバナンス上の議論の前提をそろえることを狙った枠組みである。AIは技術方式だけでなく、利用目的、運用環境、入力データ、出力の使われ方によって影響や配慮点が変わるため、個別のAI活用を一定の観点で記述し、比較や整理ができるようにすることを目的としている。

(2) AIモデルの捉え方

OECDはAIモデルを、外部環境の全部または一部を表す表現として定義したうえで、AIモデルをAIシステムの構成要素として位置付けている。AIシステムは、機械または人からの入力を受け取り、外部環境に関する情報をモデルとして表し、そのモデルに基づいて推奨や予測などの出力を生成する。出力は情報提示にとどまる場合もあれば、後段の仕組みを介して行為につながる場合もある。 また、外部環境を表す際の情報源として、データに加えて人が与える知識が含まれる点が明示されている。これにより、AIモデルは学習データに基づく表現だけでなく、専門知の組込みを含む形で外部環境を表すものとして整理される。

(3) 人の関与と自律性の4段階

OECDは、自律性を、推論結果に基づく行為がどの程度人の関与なしに実行されるかで4段階に整理している。

① No-action autonomy(human support):システムは推奨や出力を示すが、それに基づく行為を実行できない。人が推奨や出力を採用するか無視するかを任意に決める。

② Low-action autonomy(human-in-the-loop):システムは入力を評価し、推奨や出力に基づいて行為を実行し得るが、人が同意した場合に限って実行する。

③ Medium-action autonomy(human-on-the-loop):システムは入力を評価し、推奨や出力に基づいて行為を実行するが、人が拒否した場合は実行しない。

④ High-action autonomy(human-out-of-the-loop):システムは入力を評価し、推奨や出力に基づく行為を人の関与なしに実行する。

この4段階は、行為の実行における人の役割を、同意、拒否、非関与といった形で整理するものであり、人の介在の度合いを段階的に説明する際の参照として用いることができる。

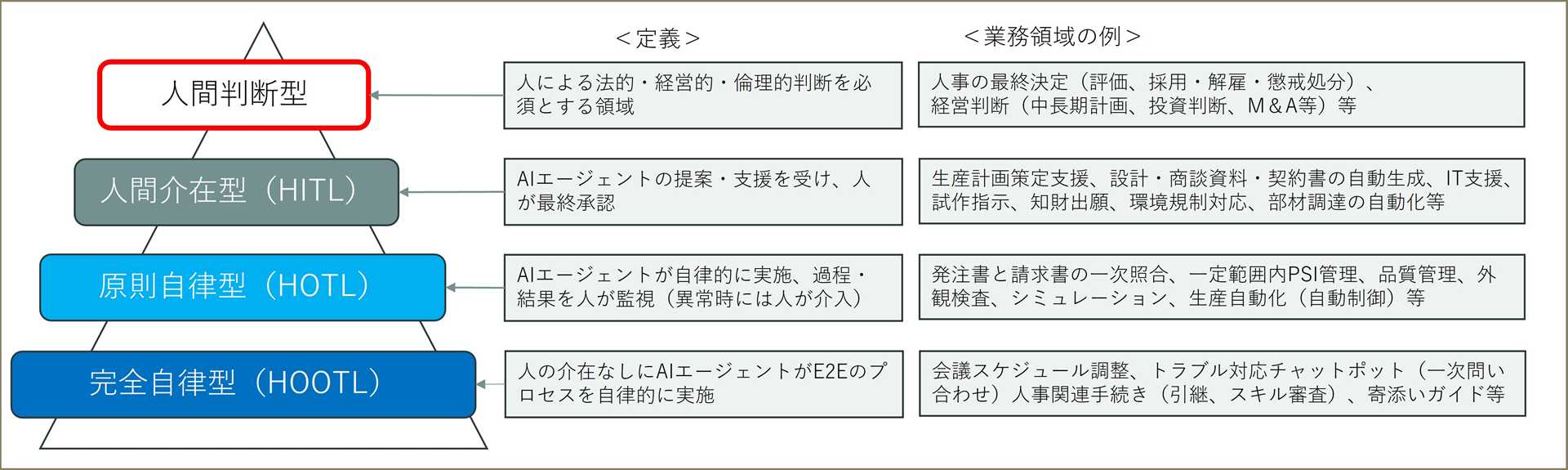

また、参考として、AIに関する包括的な欧州の規制法である”EU AI Act”は、健康・安全や基本権の保護等の観点から、リスクに応じてAIの利用の可否や求められる企業対応を整理する枠組みを採る(【図4-2】参照)。同法は段階的に施行されており、現時点での規制状態が全て表現されているわけではないことに留意が必要である。加えて、生成AIを含むAI全般を対象としており、AIエージェントに固有の問題が発見され今後取り上げられるかもしれない点にも留意が必要である。

なお、AIの出力がEU内で利用される場合には、日系企業を含めEU域外の企業であっても、この法規制の適用により事業に影響を受ける可能性があることにも留意が必要である。

【図4-2】”EU AI ACT”の概要(参考)

【出典】 経済産業省「AI原則の実践の在り方に関する検討会」第1回(2021年5月11日)資料5「EUのAI規制案の概要等」を参考に、事務局が作成。

以上を踏まえ、後述する物理系への接続や法的責任に関する各国の規制動向及び技術の発展と社会における受容度の進展を見極めつつ、段階的に許容範囲を拡大していくアプローチが望ましい。

4-3. 自律性の許容範囲の説明

自律性の許容範囲を業務に実装するに当たっては、許容範囲の設定そのものに加え、その判断が妥当であることを社内外に対して説明できる状態を整えることが重要である。特に、AIエージェントの判断が業務結果や安全性に影響し得る以上、導入・運用の設計段階から説明責任を果たすための方策を講じることが適当である。

具体的には、まず、業務の特性を踏まえ、AIエージェントが扱う安全品質や損失影響の大きさといった業務のリスク水準に応じて自律性の許容範囲を変化させるという考え方を、社内で、例えば方針のような形で明確にする必要がある。加えて、同様の考え方や枠組みを、社外を含む社会全体として求めるべきか否か、求める場合にはどのような方策が現実的かという観点も整理しておくことが望ましい。

また、運用に際しては、安全性・信頼性の確認を前提として、段階的に実行するアプローチが適当である。その際、フェイルセーフ設計を組み込み、検出精度のバリデーション24、閾値設定、継続的モニタリング及び人的介入の設計を通じて、異常時に影響が拡大しないようにすることが求められる。

さらに、過剰検知、過剰停止、見落とし、誤作動が生じた場合に備え、責任判断の考え方と責任分界のルールをあらかじめ整備しておくことが重要となる。これらを担保するためには、組織としてのガバナンス体制を整え、CoE25の設置や機能の充実、教育、運用ルールの整備等を含め、継続的に運用品質を維持・向上させる枠組みを構築することが適当である。

24バリデーション(Validation):目的に照らして、得られた結果や性能が妥当かを確認すること。例えば、検出結果が正しいか、精度が要求水準を満たしているかを検証する。

25 CoE(Center of Excellence):AIエージェントの運用やガバナンスを組織横断で推進する専門組織。台帳・登録・審査制度、監査・証跡(ログ)保持などの運用体制と合わせて必要とされる。

第5章 物理系との接続に関する論点の考察

本章では、AIエージェントの判断が設備やロボット等を介して物理世界に作用する場合に、ソフトウェア上の処理にとどまる場合とは異なる論点が生じることを整理する。製造現場では、停止・動作・条件変更といった指令が安全、事業継続、生産性、責任分界に直結し、影響が即時かつ大きくなり得るため、物理系との接続は特別な注意を要する領域として扱う。

5-1. AIエージェントの判断が及ぼす物理系への作用の事例

物理系への作用としては、例えばプラントや設備の自動停止、ロボットの経路実行、装置パラメータの自動調整による製品品質の変動等が挙げられる。これらは、過検知による操業停止、誤作動による設備損傷や安全上の支障、条件変更の連鎖による品質ばらつきの増幅等、結果が現場の損失として顕在化しやすい。

このため、物理系に作用する運用では、フェイルセーフ設計を前提に、まず監督・確認を中心とした運用から開始し、段階的に自動化範囲を広げることが基本となる。また、過剰停止や誤作動が発生した場合に備え、損害の扱いと責任分界を事前に整理しておくことが、導入・運用の設計要件となる。

5-2. 生産プロセスにおけるLLM (ソフトウェアの世界)とハードウェアとの接続方法・データ連携

現状、LLM等のプランニング層と、実機制御層を接続するための変換プロトコルや標準が十分に整っているとは言い難く、特にレガシー設備を含む現場では接続方式や運用設計が個別最適になりやすい。加えて、自然言語による指示をそのまま実機に与えるのではなく、装置やロボットが解釈可能な命令形式へ落とし込み、検証を経て実行に移す中間層が不可欠となる。

この点を踏まえると、オーケストレータ26を介して、①タスク計画・指令生成、②シミュレーション等による事前検証、③同じ条件下で同じ動作をする実行層、の3つを分離する構成が重要となる。特に誤作動が人身事故や重大な損害に直結し得る領域では、実行層の振る舞いを安定させ、インターロックや監視、ログ、再実行条件を含めて、現場が運用可能な形に落とす必要がある。こうした基盤は、個社の努力に加え、業界横断での標準プロトコル策定やAPI整備といった共同の取組も論点となる。

26オーケストレータ:複数の要素(エージェントやツール、シミュレーション層、実機制御層など)をつなぎ、全体の手順・役割分担・呼び出し順序を管理して一連の処理を成立させる中核(アーキテクチャ/役割)。

5-3. 活用に向けた課題整理

技術面では、リアルタイム性、挙動の再現性、センサ信頼性、サイバーセキュリティ、異常検知の精度と閾値、監視と介入の設計など、物理系特有の要件を満たすための検証が必要となる。法規・安全面では、製造物責任や安全規格・認証、事故時の説明責任、誤作動時の損害賠償ルールの明確化が欠かせない。経済面では、既設ラインへの追加投資やROI27の不確実性を踏まえ、パイロット導入と段階展開を基本としつつ、標準化や共通基盤の整備に伴うコストを誰がどこまで負担するかを検討する必要がある。

なお、同種の課題はソフトウェア上の運用にも存在するが、物理系に作用する場合は、人命・設備・環境・生産ラインに即時かつ不可逆の影響を与え得る点で、重大度と対応コストが大きく異なる。この差分を前提として、導入順序、確認すべき範囲と水準、運用ルール、責任分界を設計することが求められる。

27ROI(Return on Investment):投資に対して、どれだけ効果(利益・コスト削減など)が回収できるかを表す指標。投資額に対する回収額(便益)の比率、または回収の見込みを指す。

第6章 第三者の権利侵害のおそれとその法的責任に関する考察

本章では、AIエージェントの活用が社内にとどまらず、取引先・顧客・ユーザー、従業員、周辺住民などの第三者に影響を及ぼし得る場面を念頭に、権利侵害のおそれと法的責任の考え方を検討する。

AIエージェントは自律的に判断し連続的にタスクを実行し得るため、誤りが生じた場合の影響が拡大しやすく、結果として事故や規制違反、取引上の支障などの形で顕在化するおそれがある。しかしながら、政府においてAIに関する法的リスクについて様々な検討が講じられてきているが、AIエージェントに着目しその活用における法的リスクが検討されたものは限定的だと思われる。

そこで、製造業においてAI エージェントが活用される業務のうち、それが第三者に影響を及ぼす可能性がある事例を抽出し、法的責任が争点となりやすい事例と、影響は生じ得るものの直ちに法的問題に発展しにくい事例を区別して整理した上で、法的責任の基本的な捉え方を示す。加えて、AIエージェントの活用の進展を不当に阻害しないように、過誤の発生を可能な限り減少させたり、事故発生時に状況把握と説明を可能にさせたりするための実務上の措置について述べる。

6-1. AIエージェントの活用における法的責任が問われる可能性のある事例

AIのもたらし得るリスクの例に応じた関係法令は、憲法・個人情報保護法(プライバシー権)、知的財産法(著作権・意匠権等)、不正競争防止法(営業秘密やノウハウ)、民法(人格権・財産権)、製造物責任法、刑法(脅迫、名誉毀損、電磁的記録等)等多岐にわたる28。これら全てにわたり検討することは、本報告書の力の及ぶところではないし、目的とするものでもない。

したがって、第3章で紹介した製造業においてAIエージェントの利用が期待される分野のうち、第三者との関係が発生し他者の権利侵害の可能性を判断すべきと思われる事例を、次の通り、抽出した。その上で、製造業の業務を具体的に想定し、法的責任が争点となりやすい事例と、相対的に争点化しにくい事例を整理する。前者で法的責任として捉えるのは、不法行為、債務不履行、製造物責任という民事責任と、法規制違反という刑事責任又は行政責任を中心に検討した。

①生産の自律化、ヒューマノイド・ロボット

②品質管理・外観検査の自動化

③部材調達の自律化

④営業支援(引合への回答・商談資料の自動作成)

⑤環境規制への対応

⑥知的財産戦略への支援

28内閣府「AI戦略会議・AI制度研究会」中間とりまとめ(2025年2月4日)、AI 事業者ガイドライン等を参照。

(1) 民事責任が問題となり得る事例

民事責任(不法行為、債務不履行、製造物責任)が問われる可能性がある活用ケースとしては、生産自律化や外観検査において、AIエージェントの判断が製品の合否判定や工程条件に影響し、その結果として不良品が流出し、事故や被害が発生する事例が想定される。例えば、外観検査の判定誤りにより不良品が市場に流出し、顧客・ユーザーの事故や財産的損害につながる場合には、損害賠償の成否や範囲が争点となり得る。

(2) 刑事責任又は行政責任が問題となり得る事例

刑事責任や行政責任(労働安全衛生法、消防法または高圧ガス保安法等の規制遵守)が問われる可能性があるのは、生産を自律化させた業務において従業員の事故や周辺住民に被害が発生した事例が想定される。加えて、環境規制への対応を支援するAIエージェントの出力を信頼して対策を講じたにもかかわらず、AIエージェントへの入力データが更新されていないなどの理由で、結果として規制の閾値を超えた環境規制対象物質の排出が発生するというようなケースも想定できる。この場合、規制違反に至るおそれがあり、事業者としての安全・保安、環境保全の観点から対応が問われ得る。

(3) 取引上の支障は生じ得るが、法的問題に発展しにくい事例

自律的な部材発注や顧客からの引き合いへの自律的回答、商談資料の自動作成等においても、取引先・顧客に対して不適切な回答や誤った提案を行い、混乱や手戻りを生じさせる可能性はある。ただし、これらが直ちに契約違反等の法的問題に発展するケースは少ないのではないかと推察される。多くの場合、受注機会の逸失、取引条件の不利化、対応工数の増加、企業としての信用の低下など、主として自社側の不利益として顕在化しやすい。

(4) 自社の手続・戦略上の不利益にとどまりやすい事例

特許出願等の知的財産業務の支援を行うAIエージェントが出力に誤りを含み、それをそのまま出願したとしても、結果として誤った出願となる。この場合、第三者の権利侵害に及ぶというよりも、権利化の失敗や出願戦略上の不利益といった自社側の損失として整理されやすく、これもいわば自損と言える。

6-2. 第三者の権利侵害の法的責任に関する考え方

前節6-1.で採り上げた事例のうち、問われる法的責任としては、民事責任並びに刑事責任及び行政責任が挙げられる。

(1) 民事責任

民事責任については、経済産業省が2026年4月9日に公表している「AI利活用における民事責任の解釈適用に関する手引き」(以下、「手引き」という。)が、AIの開発・提供・利用に関わる当事者の責任分界の基本的な考え方を示してくれている29。手引きでは、広くAI利活用に関する想定事例が検討されており、AIエージェントだけに特化したものではない。また、AIエージェントに関するリスクアセスメントやガバナンスの手法が検討段階であること等の理由から、AI利活用における基本的な考え方を整理するにとどめられている。しかしながら、これらの考え方は「AI エージェント等高度なシステムを検討する際にも基礎として位置付け得る。」と手引きでも謳われており、責任の所在や判断枠組みの予見可能性を高め、事故時の被害回復を円滑にするうえで、有益な指針となるものと期待できる。巻末にAppendix2として、手引きの概要を紹介しているので、参照していただきたい。

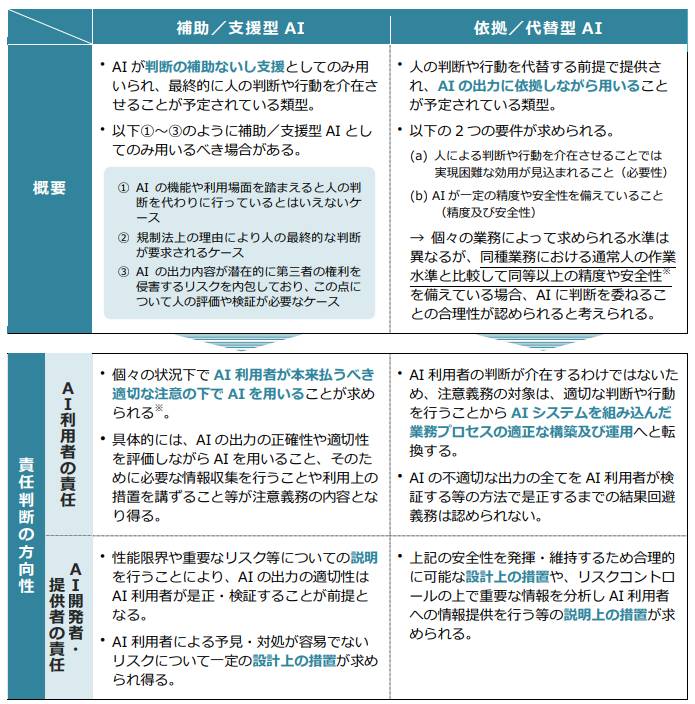

手引きでは当事者間の民事責任を考えるための整理として、AIが利活用される形態に応じた2つの類型に分けて検討している。第1の類型(補助/支援型AI)は、AIがAI利用者の判断の補助ないし支援としてのみ用いられ、最終的に人の判断や行動を介在させることが予定されている類型である。「補助/支援型AI」においては、AI利用者はあくまで自らの判断の補助や支援としてAIを用いるべきこととなり、その責任はAIの利用如何にかかわらず、個々の局面においてAI利用者が本来払うべき注意の下で適切な判断や行動を取ったか否かによって判断される。

第2の類型(依拠/代替型AI)は、必ずしもAI利用者の最終的な判断や行動を介在することが求められず、人の判断や行動の全部又は一部を代替する前提で提供され、AIの出力に依拠しながら用いることが予定される類型である。「依拠/代替型AI」においては、AI利用者の責任は、人が合理的な判断や行動を行う注意義務から、AIシステムを組み込んだ業務プロセスを適正に構築するとともに、リスクを可能な限り低減しながら運用を行う義務へと転換する。

29手引きの詳細な内容については、経済産業省「AI利活用における民事責任の解釈適用に関する手引き〔第1.0版〕」20260409001-1.pdfを参照いただきたい。

(2) 刑事責任又は行政責任

刑事責任や行政責任(労働安全衛生法、消防法又は高圧ガス保安法等の規制遵守)については、今後、AIエージェントに関するリスクアセスメントやガバナンス手法の検討が進展し、個別技術やユースケースの事例が増えることで、整理が進んでいくものと思われるが、現段階でAIエージェントの利用を以てこれまでの責任の考え方を変更すべき理由は見出せないと思われる。

刑事責任や行政責任については、法規制違反の責任が厳しく問われるのは当然としつつも、一方でイノベーションに与える影響を十分留意しつつ、AIエージェントの利活用の進展を不当に阻害しない方向での検討が期待される。「一般に、我が国の企業等は法令遵守の意識が高いとされており、規制の順守を意識するあまり、新たな研究開発やサービスの開発発展を必要以上に躊躇する可能性がある。」との指摘30には、十分耳を傾ける価値があると思われる。

30内閣府「AI戦略会議・AI制度研究会」中間とりまとめ(2025年2月4日)

6-3.AIによる過誤の発生を減少させる措置の具体例

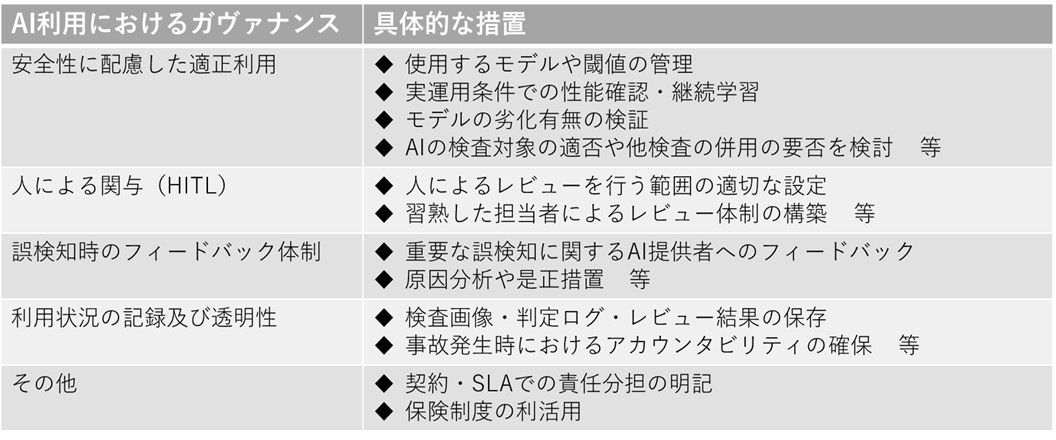

経済産業省の手引きをとりまとめた「AI利活用における民事責任の在り方に関する研究会」では、第2回(令和7年10月1日開催)において、製造品の検品サービスに外観検査AIが用いられた場合を想定事例とした検討が行われた。同研究会の事務局説明資料において、提供するサービスにAIを活用する検品受託事業者が、AIのリスクを低減するためにAIガバナンスの観点から講じ得る措置として、①安全性に配慮した適正利用、②人による関与、③誤検知時のフィードバック体制、④利用状況の記録及び透明性が具体例として挙げられている31。上記①~④を具体的に敷衍すると、次のように考えられる。

① 安全性に配慮した適正利用:業務の性質や影響範囲に照らし、想定外の用途で使わないこと、前提条件や制約を明確にした上で運用することが含まれる。

② 人による関与:重要な判断・例外対応・停止判断等で人が関与する設計とし、運用上も関与が形骸化しない体制を整えることが含まれる。

③ 誤検知時のフィードバック体制:誤検知・見落とし等が発生した場合に、原因を特定し、運用ルールや設定、学習データ・手順等へ反映できる体制を用意することが含まれる。

④ 利用状況の記録及び透明性:入出力や意思決定に関わるログ等を記録し、後日の検証や説明に耐えうる状態を確保することが含まれる。

上記に加え、実務上は、契約やSLA32において相手方との責任分担や対応範囲を明確化するなど、当事者間の整理をあらかじめ行うことも有効である。

いずれにせよ、AIエージェントの利用者が、過誤の発生を可能な限り防止する措置を採っていることが重要であり、上記の措置はAI利用者の責任の在り方の検討にとって有益であると思われる。

31経済産業省「第2回 AI利活用における民事責任の在り方に関する研究会 事務局説明資料」9頁(https://www.meti.go.jp/shingikai/mono_info_service/ai_utilization_civil/pdf/002_03_00.pdf)

なお、同資料では、挙げられた措置の全てが注意義務を構成するものではなく、検品受託事業者のサービスの内容、AIの性能・設計、AI開発者との役割分担、個々の状況に応じて求められると考えられる措置は異なると言及されている。

32SLA(Service Level Agreement):サービス提供者と利用者の間で、サービス品質の水準とその測り方(稼働率、応答時間、復旧時間など)、障害時の対応範囲、責任分担を取り決める合意(契約条項)。

【表6-1】 過誤を減少させるための措置

【出典】 経済産業省「第2回AI利活用における民事責任のあり方に関する研究会 事務局説明資料」をもとに事務局が作成(「その他」は事務局において追記)。

第7章 導入に向けた準備(基盤整備)と解決すべき課題

本章では、AIエージェントを製造業の開発・生産等のプロセスへ導入するに当たり、事前に整えておくべき基盤となる制度やインフラと、導入段階で解決すべき課題を整理する。前者の基盤整備は、データや設備との連携だけでなく、運用体制や監査・証跡の確保、規制対応に必要な情報基盤、ガバナンス体制までを含む。

また、後者で言う課題としては、技術的課題に加え、説明責任を果たすための運用ルールや、責任分担の明確化に関する制度的な課題も併せて扱う。

7-1. AIエージェント導入の目的とゴール設定

AIエージェントの導入を検討する段階では、データ整備や運用ルール、ガバナンスなど、準備すべき論点が一気に増える。こうした論点を着実に押さえることは重要だが、準備項目の整理そのものに意識が寄ると、何を優先すべきかの判断が揺れやすい。何のために導入するのか、導入後にどのような状態を実現したいのかが曖昧なままだと、整備の順序が定まらず、判断も場当たりになりやすい。そこでまず、目的とゴールの置き方を明確にし、組織として同じ方向を向ける状態を作ることを確認する。

(1) 活用の狙いのゴール設定

導入の出発点は、狙いを言葉にし、評価できる形にすることである。対象業務を定めたうえで、どこに無駄や詰まりがあり、何がどう良くなれば導入の効果が出たと言えるのかを具体化する。作業の待ち時間や段取り替えの停滞、確認・承認の往復、例外対応による中断、品質ばらつきに起因する再作業など、現場で実害として表れているボトルネックを起点に狙いを置くと、ゴールが曖昧になりにくい。

重要なのは、狙いを一般論で終わらせず、現場で評価できる形に落とすことである。どの指標で、どの程度を目標とするのかを定めれば、導入効果の確認だけでなく、次の改善や展開の判断も行いやすくなる。加えて、早期に狙う成果と、中長期に目指す到達像を分けておくと、検討の優先順位が付けやすい。早期は運用として回る形を作ることが中心となり、中長期は適用範囲をどの順序で広げるか、節目ごとに何を判断材料にするかを見通す必要がある。組織として共通のゴールと判断基準を持つことが、取組が散らばることを防ぐ前提となる。

(2) AIエージェントの活用により実現したい新たな価値づくり

AIエージェント活用のゴールは、まずは効率化や省人化といった分かりやすい価値から描かれることが多い。手順作成や確認の負担を減らす、段取り替えを早める、例外対応の初動を速くする、といった改善は導入の説明がしやすく、成果も追いやすい。

加えて、こうした改善によって確認や調整の待ち時間が大きく減ると、効率化にとどまらず、業務プロセスそのものを組み替えられる可能性が出てくる。工程間の連絡や合意に時間がかかる前提が崩れると、後工程を見越して前工程を過度に安全側へ寄せる必要が薄れ、手戻りを織り込んだ進め方を見直しやすくなる。結果として、前倒しで複数案を比較して決める、判断の節目を減らして小刻みに進めるなど、意思決定の進め方まで含めて改善の余地が生まれる。

加えて重要なのは、ゴール設定の段階で、効率化の延長にとどまらない到達像も視野に入れておくことである。完全無人化のような大きな到達像も現実味を増しつつある。さらに、既存業務の延長ではない新しい役割や業務が生まれ、業界を超えるような革新的な変化につながる可能性もある。こうした到達像も念頭に置いてゴールを描くことで、効率化にとどまらず、新しい業務や競争力につながる価値づくりへ発展させやすくなる。

(3) 経営層のコミットメント

AIエージェントの導入は、現場の工夫や一部門の取組だけで完結しにくい。適用範囲を広げ、継続的に運用していくには、設定したゴールを組織として共通目標化することと、経営層の意思決定が必要になる。まず、組織として何を優先するのか、どの領域から取り組むのかを明確にし、複数部門が同じ方向を向ける状態を作ることが重要である。取組が増えるほど、成果の定義や運用の前提がばらつきやすくなるため、共通のゴールと判断基準を置くことが、拡張の前提となる。

また、AIエージェントは、もはや情報の専門家だけが扱うものではない。業務の中で判断や実行に関わる以上、現場側の運用判断や例外時の扱い、責任の持ち方まで含めて整える必要があり、そのための対応態勢を横断的に作ることが求められる。具体的には、導入の入口を整え、適用範囲と責任分担を明確にし、継続改善が回る形を作ることが重要となる。経営層が方向性を明確にし、組織としての取組として位置付けることで、技術面・制度面の検討が実装と運用に結び付いた形で進みやすくなる。

7-2. AIエージェント導入の基盤整備に向けての準備

AIエージェントの導入は、単にモデルを選んで試す段階にとどまらず、運用を前提とした社内基盤の整備が成否を左右する。とりわけ、データの整備、運用体制、ガバナンスの3点は相互に依存しており、どれか1つが欠けると、現場展開や継続運用の段階で停滞しやすい。

また、規制対応のように社外情報を継続的に取り込む領域では、企業単独の努力だけでは限界があるため、外部環境も含めた準備が必要となる。加えて、産学官連携による技術進化や普及促進を図る社会全体としての取組も期待される。

(1) データ基盤の整備

データの高品質化が求められる。具体的には、業務に必要なデータを、収集・項目・フォーマット・更新日時まで含めて標準化し、部門や拠点をまたいでも再利用できる形に揃えることが出発点となる。加えて、匿名化やアクセス管理を前提としたデータ共有プラットフォームを設計し、誰が、何を、どの条件で使えるのかを運用モデルとして整える必要がある。

データフォーマットやデータ連携プロトコルの標準化に加え、AIエージェントを設計・開発し、評価を経て運用改善する一連の作業プロセス自体の標準化も、現場展開と継続運用の成否を左右する重要な基盤である。導入初期は、個別部門・個人の試行錯誤に依存しやすく、エージェント品質、開発速度、セキュリティ水準、説明可能性が案件ごとにばらつき、再利用が進まない一因にも成りかねない。したがって、社内の共通手順として、要件定義から運用改善までの標準プロセスを定め、成果物・判断基準・責任分界を明確化する必要がある。

また、このような作業プロセスの標準化は、過度に固定化すると現場の改善速度を阻害するため、共通化すべき必須事項(安全・品質・監査・再現性に関わる領域など)と、案件特性に応じて裁量を残す領域(プロンプト表現、インターフェース、補助ツールの選定など)を切り分け、段階的に更新・改善する運用プロセスとすることも視野に入れて、検討すると良い。

(2) ナレッジ蓄積不足への対応

導入初期は、成功・失敗の知見が属人化しやすく、運用品質が安定しない。したがって、ナレッジ蓄積に向けた社内教育と運用ルールを整備し、現場での判断基準や対応方法を共通化することが求められる。

また、AIエージェントの利活用に関するリテラシー向上のための努力も必要である。

(3) 著作権等知的財産権のクリアランス

学習・利用するデータや生成物が知的財産権に関係する場合、権利処理や利用範囲の整理が遅れると、展開の段階でブレーキになり得る。このため、利用するデータ、外部サービス、成果物の扱いを含め、事前にクリアランスの方針とルールを整える必要がある。

(4) 組織ガバナンスの整備

①AIエージェント利用指針の策定

第4章で述べた通り、自律性の許容範囲を含めた運用の前提を組織として統一することが求められる。このため、社内に適用されるAI エージェントの利用指針を策定し、構成員全体に周知徹底することが有効である。

②運用体制の整備に向けた準備

導入後の品質維持には、例えば、ネットワーク監視ツール等のウェブアプリの活用等によりアクセスの可視化や検知を行うなど、ライフサイクル全体を把握できる仕組みが不可欠となる。併せて、監査・証跡としてログを保持し、問題発生時に原因究明と是正ができる状態を作る必要がある。上記の他にも、台帳を用意して登録審査をルール化するなどの方法も選択肢となり得る。

また、AIエージェントのメンテナンス、参照データや利用モデルのアップデート等のルール及び責任者を明確にしておくことが、品質の維持・向上のために不可欠である。

さらに、各部門が個別にエージェントを作成・運用し、全社として把握できないまま増えていく、いわゆる「野良」AI化が起こり得る。「野良」AI化が進むと、品質や責任の所在が曖昧になり、部署間で前提の異なる運用が広がって統制が効きにくくなる。したがって、作成・導入の入口を一本化し、利用範囲と責任の線引きを明確にした上で、全社として一貫した運用基準のもとで展開できる状態を作ることが重要となる。

③リーダーシップの発揮と責任の明確化

CoEのように組織横断で運用とガバナンスを推進する専門体制を置き、現場任せにしない形で継続改善できる状態を整える必要がある。

(5) 社会全体としての取組

①規制データベースの構築・整備

環境規制対応のように、社外の制度情報に依存する領域では、企業内データの整備だけでは不十分であり、外部の規制情報を継続的に取り込める基盤が必要となる。具体的には、自治体による上乗せ・横出し規制を含め、最新情報を反映した規制データベースの整備と更新が求められる。これは、環境分野に限らず、他の規制分野においても同様に外部データ基盤が必要となる。

②人材育成

製造業における開発・生産プロセスへのAIエージェントの活用を進めるためには、社内外を問わず、産業界で横断的に人的リソースを育成・確保することは、重要な課題である。

③産学官連携による技術進化や普及促進の支援

後述の技術的課題や制度的課題の解決は、個社だけの努力では実効性が上がらないものもある。技術の進化やその普及を停めずに促進していくべく、新たな技術の相互検証を行うテストベッド等の整備により様々な企業や大学が利用できる環境を形成していくことが考えられる。また、技術・資金・人材・インフラ等の面での中小企業支援も検討されるべきである。

7-3. AIエージェント導入の技術的課題

製造業でAIエージェントを業務に組み込むには、生成した計画や判断を、現場の設備・システムが安全かつ確実に実行できる形に落とし込む必要がある。このとき、システム間のつなぎ込みを個別最適で作り込むだけでは、拡張性や安全性の担保が難しくなるため、業界横断での標準化と、層を分離した設計が技術課題となる。

(1) 安全性・フェイルセーフ機能の確立とセキュリティリスクへの対応

すでに第4章や第5章で言及されている通り、安全性・信頼性を確保するための技術的対応を講じることは、AIエージェント利用の前提である。その上で、フェイルセーフ設計を組み込み、検出精度のバリデーション、閾値設定、継続的モニタリング等を自社の利用分野に応じ、最適な設計を講じることが必要である。

また外部データや外部サービスを利用する場合には、暗号化通信や厳格なアクセス制御などのセキュリティ対策を講じることはもちろん、内部・外部の区別に依存せず信頼を前提としない設計原則(ゼロトラスト)に基づき、すべてのアクセスを継続的に検証する。

特に、物理系との接続の場合には、クラウド層とエッジ層との分散制御等のリアルタイム性向上に加え、センサ等実機側も含めた安全性・信頼性がより一層問われることに留意すべきである。

(2) プランニング層と実機制御層の変換プロトコルの標準化

プランニング層が出す指示を、そのまま設備制御に流すのではなく、オーケストレータを介して、シミュレーション等による検証層と、決定論的に動作する実行層を分離する設計が求められる。特に、安全クリティカルな領域では、実行層は入力形式、許容範囲、停止条件などが明確なプロトコルで動作し、プランニング層の揺らぎが直接影響しない構造が必要となる。

(3) 設備連携インターフェース

加工機・センサ等との通信プロトコルやAPI33を標準化し、設備ごとの差異を吸収できる仕組みを整える必要がある。あわせて、レガシー設備との互換性確保が課題となるため、ゲートウェイや中間ミドルウェアを用いて段階的に接続可能にする方策が重要となる。これらは個社努力だけでは収束しにくく、業界横断での整理が求められる。

33API(Application Programming Interface):ソフトウェア同士がデータや機能をやり取りするための取り決め。呼び出し方、入力・出力の形式、エラー時の扱いなどを定め、異なるシステム間でも連携できるようにする。

7-4. AIエージェント導入の制度的課題

AIエージェントの導入では、技術的に動くことに加えて、運用として説明可能であること、過誤が起きた際に検証可能であることが求められる。特に、判断や実行を一定程度委ねる運用では、例外時の扱い、記録の残し方、責任の整理が曖昧なままでは、社内外への説明責任を果たしにくい。こうした観点から、制度面の整備は、精度や性能評価と並んで導入の前提条件となる。

(1) 説明責任を果たすルール整備

例外処理とエスカレーションのルールを、閾値・トリガの明確化にとどめず、担当者の権限や承認フローと結び付けて運用できる形に落とし込む必要がある。あわせて、監査・証跡としてログを保持し、後日の検証や社内外への説明に耐えうる状態を確保することが求められる。さらに、モデル定款や契約・SLA等を通じて、誰がどこまで責任を負うのかを整理し、責任負担の境界を明確化する枠組みを整える必要がある。

(2) 法的責任の在り方

導入後に問題が発生した場合、民事責任に限らず刑事・行政責任が論点となる可能性がある。したがって、政府の指針や制度動向を踏まえた運用設計を行い、社内ルールや監督体制がそれと整合するように整えることが求められる。また、損害賠償保険制度の活用や導入の検討は、リスクを現実的に受け止めた運用設計の一部として位置づけられる。

(3) AI利用の明示方法

AIエージェントを利用している事実を、社内外にどのように示すかも制度的な論点となる。用途や影響範囲に応じて、認証等を含む明示方法を整え、利用状況の透明性を高めることが求められる。

(4) 社会全体としての取組

上述の説明責任を果たすルールや責任の分界を個社のレベルを超えた形で、例えば業界ベースまたは業界横断的に、行政または経済団体や業界団体がモデル定款等で示していくことが有益である。第6章 6-2で紹介した経済産業省の「AI利活用における民事責任の解釈適用に関する手引き」が、こうした社会での取り組みを促進することを望むものである。

加えて、AIエージェントの品質やセキュリティ等に関する認証制度を整備してはどうかとの意見がフォーラム委員から挙げられた。

以上のとおり、AIエージェント導入の制度的課題は、モデル性能そのものだけでなく、例外時の運用、検証可能性、責任の境界、透明性を含む制度設計と一体で捉える必要がある。これらを事前に整備しておくことで、導入後の手戻りや説明負担を抑えつつ、段階的な適用範囲の拡大に耐えうる運用基盤を形成できる。

第8章 おわりに ~AIエージェント導入に向けた方針・手順~

「適切な方針と対応」に基づくAIエージェントの導入により、人手では不可能な規模の分析、人力のみでは到達できない精度と安定性を持つ業務を実現していくことは、産業競争力の確保のみならず社会的厚生の増大の観点からも極めて重要である。

AIエージェントの活用が業務の効率化や品質向上に寄与し得る一方で、とりわけ実機制御などを通じて物理系に作用する場合、財産にとどまらず、人命・環境・社会に即時かつ不可逆の損害を与えるおそれがある。この場合、ソフトウェア領域での一般的な機能回復やロールバックでは済まず、事故時の重大度と対応コストが大きく増大しやすい点に留意が必要である。しかしながら、これらの点を懸念するが故に、AIエージェントの導入や利活用を躊躇するのは適切な姿勢とは言い難い。

そこで、個々の企業において考え得る、「適切な方針と対応」に基づく導入とは、次の点である。巻末にAppendix 1として、導入に向けた詳細なチェックリストを添付しているので参照していただけると幸いである。

(1)小さく生んで大きく育てるアプローチ

AIエージェントの活用による効果が大きくリスクが小さい分野から導入し、段階的に拡大させる。そのためには、解決すべき具体的な課題を特定し、測定可能な目標を事前に設定することである。導入目標を明確化し、定期的な評価で達成度や失敗を確認するPDCAサイクルを回すほかない。

(2)経営戦略の一環であるとの認識の共有

AIエージェントの導入は単なる技術面の改善ではなく、業務プロセスを含めた変革と価値創造の手段と捉えるべきである。AIは脅威ではなく、新戦力と考えるイノベーション文化の醸成とともに、上記の導入方針を社内で共有することが必要である。

(3)信頼性確保のための基盤整備投資の重視

データ品質はAI エージェント導入の鍵と言える。統合されたデータ基盤の整備、強固なセキュリティ対策、拡張性のあるシステムの整備やフェイルセーフ機能を持ったガードレール等技術的側面に加え、緊急時の人の介在のルールや自律性の拡大に向けた倫理指針、ガバナンスの整備等も必要となる。

また、政府においては、AIエージェント導入に必要な環境規制等に関するデータの収集整備や、事故時を含む責任分界の考え方を示す等、その導入に向けた社会的準備をお願いしたい。

本文中にも述べたが、AIエージェントは、導入したら終わりという単なる機械ではない。教育訓練と監督がないと成長せず、大きな潜在能力を発揮させることができない存在と言える。我々が、通常の組織内で、新入社員や移動してきた社員をチームの一員に加えていくときの作業と同じである。この慣れた作業だという認識を以て、AIエージェントが導入され、期待される効果を発揮されることを望むものである。

Appendix

[Appendix 1] AIエージェントの活用チェックシート

(注)各項目の対応すべき者として想定する者を、次の3類型に分け、それぞれ該当者を■で示す。

□経営層、□現場責任者・担当者、□システム開発・導入・運用者

(1) 活用の狙いとゴール設定

<対象者: ■経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ AIエージェントを活用する狙いが明確か

☐ 活用の結果として到達したいゴールが明確か

☐ 目先の改善だけでなく、その先に実現したい新たな価値は具体的に示されているか

☐ 活用のゴールが、組織内の共通目標として共有されているか

☐ 経営層が活用を進める意思を明確にし、進め方と体制について組織内で合意形成できているか

(2) 目的と適用範囲

<対象者: □経営層、■現場責任者・担当者、□システム開発・導入・運用者>

☐ 対象業務と期待効果を、短期と中長期に分けて整理しているか

☐ 成果の定義が、品質・時間・コストなど評価可能な形になっているか

☐ 実証から展開までの時間軸と、意思決定の節目が明確か

☐ 横展開できる部分と、都度作り直す部分を区別しているか

(3) 自律性の設計と人の関与

<対象者: □経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ AIに任せる範囲と、人が最終判断する範囲を業務単位で切り分けているか

☐ 停止・差し戻し・承認の手順があり、例外時に人が介入できるか

☐ 例外時のエスカレーションが、権限と承認フローまで含めて運用できるか

☐ 判断根拠や経緯を後から追えるようにしているか

☐ 現場での責任分担が誤解なく共有されているか

(4) 物理系との接続と現場導入

<対象者: □経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ ソフト側で扱う範囲と、物理側の制御・安全設計で扱う範囲を切り分けているか

☐ 現場制約や物理現象の前提を、システム要求として落としているか

☐ 実証と展開の優先領域、導入順序、時間軸が明確か

☐ 初期導入で生産性が一時的に下がる可能性を織り込み、評価の仕方を決めているか

(5) データ基盤と外部データ

<対象者: □経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ 対象業務に必要なデータが確保できているか、または確保の見通しがあるか

☐ 必要なデータが不足している場合、確保に向けた戦略と手段が用意できているか

☐ 業務データを、収集・項目・フォーマット・更新日時まで含めて標準化しているか

☐ 匿名化やアクセス管理を前提に、データ共有の運用モデルがあるか

☐ 表形式・数値データなど、意図した理解が難しいデータの整備方針があるか

☐ 規制対応など社外情報が必要な業務で、外部データを継続的に取り込む更新手順があるか

(6) 出力品質の確保と検証

<対象者: □経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ 要求水準に応じて、運用設計を変える方針があるか

☐ 1つの仕組みで完結させず、用途別に役割分担できているか

☐ 役割分担した結果を突き合わせる検証の仕組みがあるか

☐ 例外時の判断や復旧の手順が、運用ルールとして決まっているか

☐ 入力・参照情報・実行操作・出力を、後から再現できる粒度でログに残しているか

(7) システム連携と標準化

<対象者: □経営層、□現場責任者・担当者、■システム開発・導入・運用者>

☐ プランニングの指示が、そのまま実機制御に流れない構成になっているか

☐ 検証と実行を分け、実行側が決定論的に動く設計になっているか

☐ 実行側の入力形式、許容範囲、停止条件が明確か

☐ 設備連携インターフェースの方針があり、設備差を吸収できる見通しがあるか

☐ レガシー設備を段階的につなぐ方針があり、ゲートウェイ等の位置付けが明確か

(8) セキュリティと外部連携

<対象者: □経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ 外部サービスや外部データを使う場合、持ち出しや漏えいの条件整理ができているか

☐ 権限の付与が最小限になっているか

☐ エージェントが実行できる操作を、業務上必要な範囲に絞れているか

☐ 想定外の動きが起きた場合の検知と停止手順があるか

☐ 作成と導入の入口が一本化され、無断導入を防げる状態か

(9) 知財・法務と説明責任

<対象者: ■経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ 学習・利用データ、外部サービス、成果物の扱いにクリアランス方針とルールがあるか

☐ 第三者への影響を想定し、権利侵害リスク低減と発生時の対応を検討しているか

☐ 出力ミスが自社損失として顕在化するケースも想定しているか

☐ 問題発生時に、民事責任だけでなく刑事・行政責任が論点になり得る業務か整理しているか

☐ 保険など、リスクを現実的に受け止める手当ての要否を検討しているか

(10) 運用体制とガバナンス

<対象者: ■経営層、■現場責任者・担当者、■システム開発・導入・運用者>

☐ 教育と運用ルールで、現場の判断基準や対応方法を共通化しているか

☐ AIエージェントの導入後の品質維持の方法を定めているか

(ウェブツールの活用等によりアクセスの可視化や検知など)

☐ 監査・証跡としてログを保持し、問題時に原因究明と是正ができるか

☐ 利用指針を定め、自律性の許容範囲を含む運用前提を組織として統一しているか

☐ 組織横断で運用とガバナンスを推進する専門体制があり、継続改善が回る状態か

☐ 用途や影響範囲に応じて、AIエージェント利用の明示方法を定めているか

[Appendix 2] 「AI利活用における民事責任の解釈適用に関する手引き」の概要

経済産業省は、「AI利活用における民事責任の在り方に関する研究会」34を開催し、そこでの議論を基に、「AI利活用における民事責任の解釈適用に関する手引き〔第1.0版〕」(以下、「手引き」という。)を取りまとめた。手引きは、2026年2月18日から3月19日までのパブリックコメント過程を経て、2026年4月9日に発表されている35。

本フォーラムのテーマである製造業のAI エージェント活用の観点から重要と思われる点を、手引きから引用しつつ、以下に紹介する。なお、下線は事務局が付したものであり、手引きに記載されたものではない。

34経済産業省「AI利活用における民事責任の在り方に関する研究会」2025年8月から2026年1月の間に全4回開催

(https://www.meti.go.jp/shingikai/mono_info_service/ai_utilization_civil/index.html)

35経済産業省「AI利活用における民事責任の解釈適用に関する手引き」(https://www.meti.go.jp/shingikai/mono_info_service/ai_utilization_civil/20260409_guideline.html )

1.手引きの目的

(1) 目的

手引きでは、「AIに関連する損害等が発生した際には、既存の民事責任ルールに基づく解決が重要になる一方、AI の自律性やブラックボックス性を踏まえてどのような解釈運用を行うべきか、裁判例の蓄積や統一的な見解がなく、責任の所在が不明瞭であることがAIの開発や導入を躊躇させる一因となっているとの指摘もあり、AIの開発・提供・利用に関する責任分界についての検討の必要性を指摘する意見が複数寄せられている。」と検討に至る背景を説明している。こうした背景を踏まえ、「現行法がどのように適用され得るかの方向性を示し、AIの開発・提供・利用に関わる当事者の予測可能性を高め、AI 利活用の推進及び損害発生時の円滑な解決に資することを目的とするものである。」としている。

(2) 留意点

手引きでは、広くAI利活用に関する事例を検討しており、本フォーラムのようにAIエージェントのみに焦点を当てた検行っているわけではないことに、留意が必要である。

2.手引きの採用するアプローチ

手引きでは、AIが利用される形態に応じた2つの類型(「補助/支援型AI」及び「依拠/代替型AI」)に整理した検討が行われている。また、AIを用いたサービスやシステムが事故に寄与した具体的なユースケースがそれぞれ想定事例として示されており、理解の助けとなる。

(1) 一般不法行為及び製造物責任

手引きでは、 AIの利活用に伴って何らかの損害が発生した場合の法的な責任について、不法行為(民法709条) 及び製造物責任(製造物責任法3条)を中心に以下のような検討が行われている。

一般不法行為に基づく責任の要件のうち、過失について、従来の考え方では、人による行為を想定し、当該人の判断や行動について注意義務違反が認められるか否かが焦点となってきた。しかし、AIの自律性との関係で、特に人が自ら判断や行動を行っているわけではない場面において、過失をどのように捉えるのかが重要な論点となる。

また、物理系との接続についても議論を行ってきた本フォーラムでは、製造物責任についても大きな関心を有している。

製造物責任法は民法上の不法行為法の特則で、製造物の欠陥により、人の生命、身体又は財産に損害が生じた場合、過失の有無にかかわらず損害賠償責任を認めることにより、被害者の立証責任を軽減することを目的としている。製造物責任法では、製造物責任の対象は動産に限られ、AI等のソフトウェア自体は対象とはならないものの、ソフトウェアが製造物に組み込まれた場合には製造物責任が生じ得る。

(2) 補助/支援型AI 及び依拠/代替型AI

手引きでは、「補助/支援型AI」及び「依拠/代替型AI」について、以下の表のとおり整理されている。

出典:経済産業省 「AI 利活用における民事責任の解釈適用に関する手引き〔第 1.0 版〕」

3.本フォーラムの議論への示唆

手引きにおいて、「依拠/代替型AI」の類型で議論の題材とされている2つの想定事例(外観検査AI、自律走行ロボット)及び補論として取り上げられている AIエージェントは、本フォーラムが行うAIエージェントの製造業における活用方策の検討にとって示唆に富み有用であると思われるので、以下に手引きからの引用を中心に紹介する。

なお、手引きで類型化されている「補助/支援型AI」と「依拠/代替型AI」の概念は、各当事者の法的責任を検討するための類型であり、本フォーラムで用いたAI利用時の物理的な人の介在程度(自律性)を表す類型であるHITL(補助)、HITL(相談)、HOTL、HOOTLとは切り口が異なり、そのまま比較使用することは適切でないことに留意が必要である。

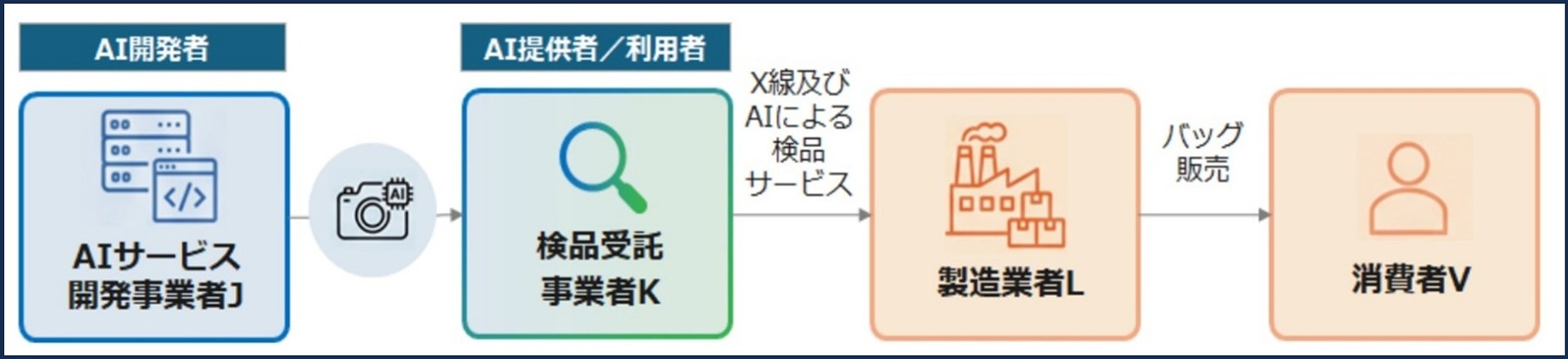

(1) 外観検査AI

①想定事例の概要

- 検品受託事業者Kは、AIサービス開発事業者Jの開発した画像認識AIとX線検査装置を組み合わせ、製造品を検査し異物を高精度で発見できる検品サービスを提供し、バッグ製造販売業者Lが当該サービスを利用していた。

- あるとき検品において、バッグに混入したカッターナイフの刃先を発見できず、バッグ製造販売業者Lからバッグを購入した消費者Vが負傷した。

【参考図】外観検査AI

出典:経済産業省「AI 利活用における民事責任の解釈適用に関する手引き〔第 1.0 版〕」

②主な論点

- バッグ製造販売業者Lの責任

- 消費者Vが負傷したことについて、製造物責任を負うと考えられる。

- 検品受託事業者Kの責任

- Kの注意義務は次の観点から評価される。

①AIシステムを組み入れた業務プロセスを適正に「構築」していたか。

②リスクを可能な限り低減しながら「運用」を行っていたか。

- Kの注意義務は次の観点から評価される。

- AIサービス開発事業者Jの責任

- 誤検知の可能性を可能な限り低減する設計を行うとともに、リスクコントロールのため重要な事項についての説明を行っていたかどうかが重要となる。

- 同種業務における通常人の作業水準が基準となりつつ、JとKの契約内容も踏まえて精度を評価し、AIがこれに適合している場合には、Jの責任が生ずる可能性は低い。

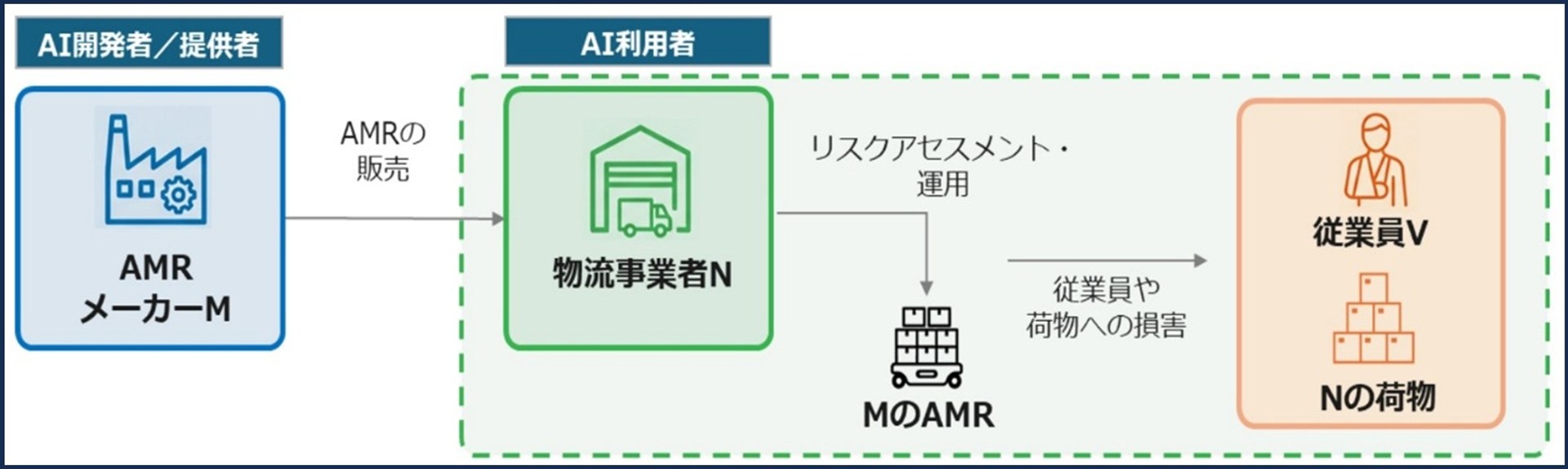

(2) 自律走行ロボット(AMR:Autonomous Mobile Robot)

①想定事例の概要

物流事業者Nは、AMRメーカーMの製造・販売する台車型AMRを購入した。当該AMRは、長期間に亘って安全に稼働していたが、ある日、多量の荷物を運搬中に事故が発生した。

| 事例a | AMRの前方にいた従業員Vに衝突し負傷させた。事故発生には、次の事情が存在した。 |

| 事例a1 | 停止距離を過少に計算してしまうバグがあったため、搭載されている保護停止機能が遅れ衝突した。 |

| 事例a2 | Nがメンテナンスを怠り、表面の汚損によりセンサ感度が低下し、検知、警報、制動が遅れ、衝突した。 |

| 事例a3 | 保護停止機能に加え、3Dカメラと画像認識AIを搭載し、接近する作業員を検知し、早期に警報を発しながら減速するように設計されていたが、Vが巨大な脚立を肩に担いで横向きに持ちながら移動していたため、人と検知できず、警報・減速を行わなかった。その後、保護停止機能が作動するも、間に合わず衝突した。 |

| 事例b | 引き渡し後のソフトウェア・アップデートによって、停止距離を過少に計算するバグが生じ衝突事故が発生した。 |

| 事例c | AMRに搭載された自己診断AIのトラブルシューティング機能が、AMRのバッテリが高温となった際温度センサの一時的な異常と判断し充電禁止のセーフガードを無効化する対応策を提示した。従業員が診断に従ったところ、バッテリが高温になり発火し、倉庫内のNの荷物に延焼した。 |

【参考図】自律走行ロボット(AMR:Autonomous Mobile Robot)

出典:経済産業省「AI 利活用における民事責任の解釈適用に関する手引き〔第 1.0 版〕」

②主な論点

<事例a>

●AMRメーカーMの製造物責任

【事例a-1】

ソフトウェアのバグにより本来の保護停止機能が発揮されず事故が生じており、「設計上の欠陥」に該当する可能性が高い。

【事例a-2】

ユーザーのメンテナンス不備も合理的に予見される誤使用と考えられ、一定のフェイルセーフとしてセンサ感度の異常を検知・警告する仕組みを備えていたかが問われる。このような機構を備えていた場合、「設計上の欠陥」に該当する可能性は低い。また、表面の汚れによるセンサ感度の低下リスクや必要なメンテナンス方法を説明している場合、「指示・警告上の欠陥」にも該当しない。

【事例a-3】

安全設計が機能していたもののVの突然の接近で事故が生じた場合、「欠陥」を否定する考慮要素となる。また、AIの誤検知に備えて保護停止機能が備わっている場合、特異なシルエットを検知できなかったことを以て「設計上の欠陥」に該当する可能性は低い。その他にユーザーにおける事故回避措置や走行上のリスクにかかわる説明の有無等も考慮され得る。

●物流事業者N及び従業員Vの責任

Nの責任:機体の適切なメンテナンスを怠っていたこと(事例a-2)、誤検知が生じやすい荷物の運搬を避けたり、臨時トラブル対応時にはAMRの稼働を休止したりする等の事故回避措置を怠っていたこと(事例a-3)について、安全配慮義務違反と評価される可能性がある。

Vの過失:事故との関係でVに過失が認められる場合、過失相殺として損害賠償額が減額され得る。

<事例b>

●Mの製造物責任

製造物責任における欠陥判断の基準時は一般に製造物の引渡し時と解されているところ、引渡し後のアップデートにより生じた不具合を欠陥判断において考慮し得るかについて、2つの見解(①引渡し時にアップデートによる不具合の潜在的な原因があった場合、欠陥が存在したと評価し得るとする考え方、②引渡し時にアップデートが予定されている場合、最終アップデート時点までの影響を考慮し得るとする考え方)が示されている。

<事例c>

●Mの製造物責任

「依拠/代替型AI」に該当する場合:セーフガード無効化等の危険な行動を推奨しており、通常の技術者と比較して安全性に欠ける出力を行っていると解される可能性が高く、危険な設定変更へのアクセス制御等を講じていない場合「設計上の欠陥」と評価される可能性もある。

「補助/支援型AI」に該当する場合:機能や利用場面、利用方法等について説明が行われている場合、指示・警告上の欠陥が認められる可能性は低い。また、上記説明に基づき、AIが誤出力をしたとしてもNにおいて検証・是正することが予定されており、設計上の欠陥には該当しないと考えられる。

●Nの責任

危険に繋がり得るAIの出力に漫然と従わないよう教育・管理上の措置を講じなかった場合等、過失相殺により賠償額が減額される可能性がある。

(3) AIエージェント

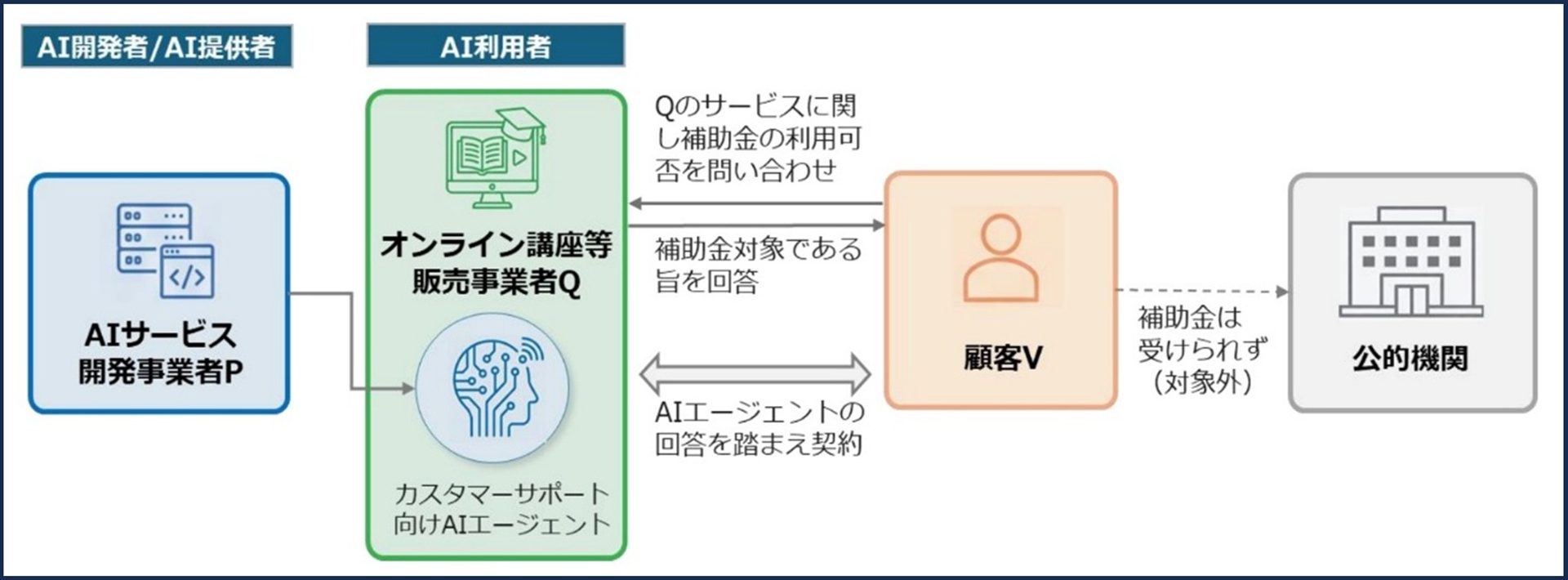

①想定事例の概要

- オンライン講座等販売事業者Qは、AIサービス開発事業者P が開発したAIエージェントを導入し、カスタマーサポートの大部分を自動化している。

- 顧客VがQの講座が公的な補助対象となるか質問したところ、当該AIは補助対象になるという誤った回答及び勧誘をし、Vが当該講座の受講を申し込んだが、後から補助の対象とならないことが発覚した。

【参考図】カスタマーサポートAIエージェント(手引きでは、「AIエージェント」)

出典:経済産業省「AI 利活用における民事責任の解釈適用に関する手引き〔第 1.0 版〕」

②本想定事例についての留意点

- 手引きでは、AIエージェントに関するリスクアセスメントやガバナンス手法が検討段階にあること等の理由からAI 利活用における基本的な考え方を整理するにとどめられているが、これらの考え方はAIエージェント等高度なシステムを検討する際にも基礎として位置付け得るとしている。

③主な論点

- AIの位置付け

- 「補助/支援型AI」にも「依拠/代替型AI」にも該当する可能性がある。

- AI利用者の責任

- 「依拠/代替型AI」に該当する場合:Qの注意義務は、AI システムを組み入れた業務プロセスの適正な構築及び運用に関する義務へと転換する。

- 「補助/支援型AI」に該当する場合:AIの誤った出力を顧客への回答に用いた場合、従業員の判断についての注意義務違反(Qの使用者責任も含めて)やAIの出力内容の検証への人の関与の不十分さについての注意義務違反が認められる可能性がある。

- AI開発者・提供者の責任

- 「依拠/代替型AI」に該当する場合:人の判断や行動を代替するに当たり予定された精度水準を発揮・維持するため、必要な設計上の措置を行ったか、人の関与を介在させるべき範囲等リスク管理のための重要な事項をQに説明したか等が重要な論点となる。

- 「補助/支援型AI」に該当する場合:AIの機能や利用場面、重要なリスク等をQに説明したかが重要な論点となる。

[Appendix 3] 製造業のAIエージェントの活用事例

(注)本報告書において、製造業のAIエージェントを活用することが期待される分野を紹介した分類に従い、事務局がインターネット等の情報を収集し例示したものである。事例を網羅的かつ包括的に示すものではないことに留意が必要である。

(2026年4月現在の情報、順不同)

①開発設計分野

【知識継承】

トヨタ自動車によるエンジニアの知見の継承へのAI エージェントの活用事例

【リンク先】マイクロソフトサイト

②生産分野

【AIロボット】

ファナックによる産業用ロボットへのフィジカルAI実装事例

【リンク先】ファナックサイト

【AIロボット】

安川電機とソフトバンクによるフィジカルAIロボットの共同開発事例

【リンク先】安川電機サイト

【設備故障診断】

ダイキンと日立の協創による工場の設備故障診断を支援するAIエージェントの活用事例

【リンク先】ダイキンサイト

【設備故障診断】

三菱ケミカルによるプラント設備の故障診断へのAIエージェントの活用事例

【リンク先】デジタルクロスサイト

【製造工程改善】

東芝による製造ラインの問題発生時の原因究明へのマルチAIエージェントの活用事例

【リンク先】マイクロソフトサイト

【プラント自動制御】

サウジアラムコと横河電機による大規模ガス製造プラントへの自律制御AI導入事例

【リンク先】横河電機サイト

【設備点検】

日本板硝子によるAI搭載小型点検ロボット導入事例

【リンク先】NSGグループサイト

③上記以外の分野

【廃棄物分別】

PFUによる廃棄物分別・検知へのAI活用事例

【リンク先】PFUサイト

【車載システム】

日産自動車によるドライバー支援への車載エージェント活用事例

【リンク先】日産サイト

【行政運営】

足立区、NEC、Google CloudによるAIエージェント搭載の政策ダッシュボード構築事例

【リンク先】PRタイムズ 日本電気株式会社のプレスリリース

【業務効率化】

ZOZOによる自社AI指標の導入事例

【リンク先】ZOZOサイト

【業務効率化】

NTTデータによる業務最適化のためのAIエージェント開発環境の提供事例NTTデータによる業務最適化のためのAIエージェント開発環境の提供事例

【リンク先】NTTデータサイト

【業務効率化】

伊藤忠テクノソリューションズによるAIエージェントの導入支援事例

【リンク先】伊藤忠テクノソリューションズサイト