近年の AI(Artificial Intelligence、人工知能)技術への関心の高まりと相まって、その利用による社会的リスクについても関心が高まり、そのガバナンスの必要性が指摘されています。

計 10 回にわたる本コラムでは、このような AI 技術による社会的リスクとそのガバナンスを巡る全体像について俯瞰していきます。

本連載の筆者は、市川類 東京科学大学 データサイエンス・AI全学教育機構 特任教授 / 一橋大学 イノベーション研究センター 特任教授 です。

©2024 Tagui Ichikawa(本コンテンツの著作権は、市川 類 様に帰属します)

第8回 コンテンツ規範に係る社会的リスク

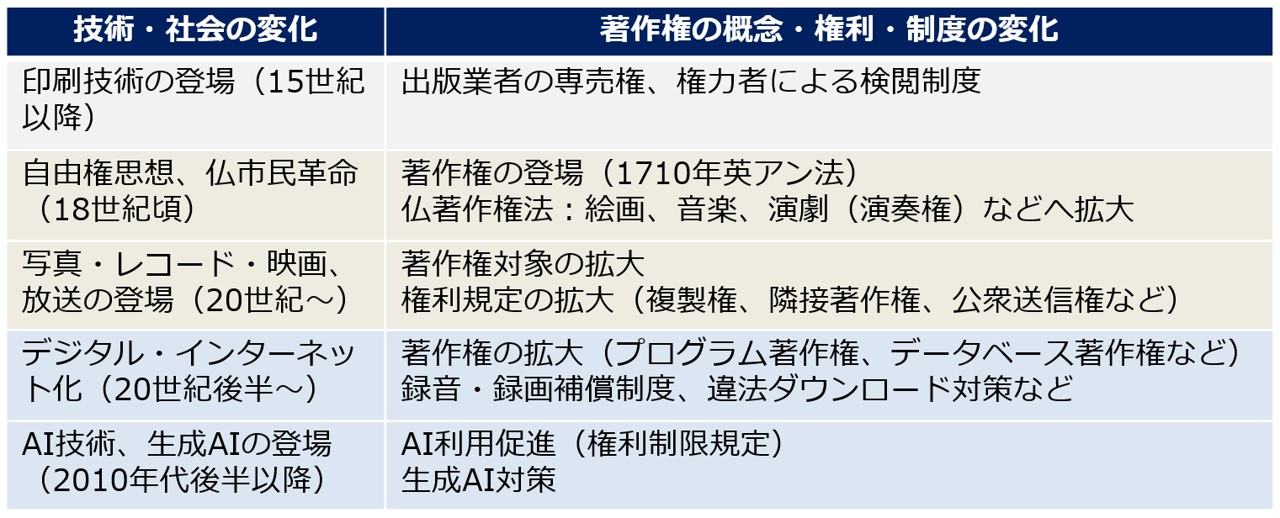

(1) 著作権制度における技術と制度の共進化

もともと著作権の概念は、印刷技術の登場を契機に発祥したものです。その中で、印刷技術を利用する出版業界による専売権確保の要望、為政者によるコンテンツ規制の欲求などを背景にしつつも、当時の欧州における自由権・人格権の尊重の動きとあいまって、著作権に係る制度が整備され、また、対象範囲も、従来の書籍に加えて、絵画、音楽、演劇などにも拡充されてきました。

その後も、カメラ(写真)、レコード(録音)、録画・映画などの技術の進展に伴い、 著作権制度の対象範囲は拡充され、その内容も変化してきました。特に、最近では、デジタル化とインターネットの普及に伴い、現時点でも著作権制度の在り方は常に見直しがなされ、変化する傾向にあります。そのような意味で、著作権制度も、技術と制度が共進化してきた分野であると言えます(図22参照)。

このような中、第三次 AI ブームが起きました。その際、従来型の AI 技術はコンテンツをデータとして学習することもあるものの、データ処理・解析が中心であり、著作権者の業務・利益には大きな影響を与えなかったことから、むしろ AI での著作物の利用促進の観点から 2018 年に著作権法の改正が行われ、その結果、AI の学習にあたって、原則として著作者の許諾を得ずとも利用できるようになりました。

図22:技術の進展と著作権制度の変化

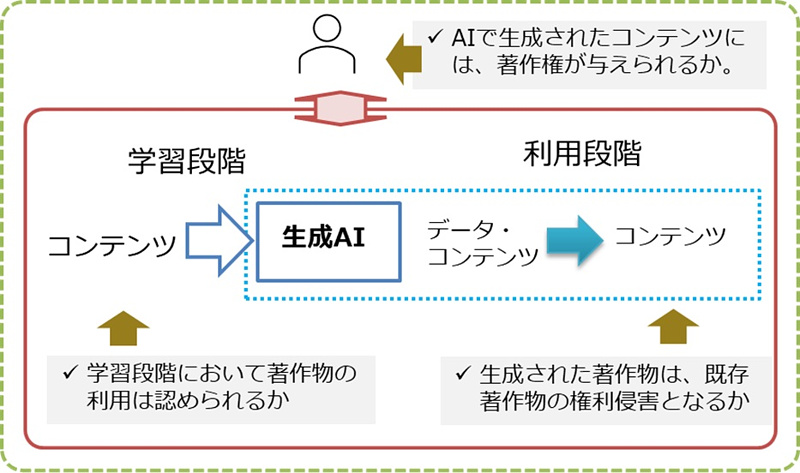

(2) 生成 AI の登場と著作権に係る社会的リスク

このような中、2022 年頃になって生成 AI が登場し、その普及が急速に進展してきています。この生成 AI は、文章、画像などのコンテンツを学習し、その上で新たなコンテンツを生成するシステムであることから、イラストレーター、執筆家などの著作権者はもとよりコンテンツ業界などの業務・利益に大きな影響を与えることが想定されます。このため、これらの業界を中心に著作権法の見直しを要求するなど、社会的に大きな議論となっています。

このような中、文科省(文化庁)は、AI と著作権との関係に係る検討会を開催し、2024年 3 月には報告書(「AI と著作権に関する考え方について」文化審議会著作権分科会法制度小委員会)を発表しました。また、政府の知的財産戦略本部も、著作権以外の知的財産権の在り方を含めた検討を行い、2024 年 5 月に報告書(「AI 時代の知的財産権検討会 中間とりまとめ」(AI 時代の知的財産権検討会))を発表しています。いずれも、原則として、著作権者の関心事項を中心に、現行法をベースとした行政府としての解釈を示したものとなっています(図23参照)。

生成 AI の技術は、現在でも急速に発展しており、今後、その利用方法によっては、さらにコンテンツ利用に係る社会規範に抵触する事例が多数生じる可能性があります。このため、生成 AI の開発・利用にあたっては、このような報告書を参考にしつつも、さらに国際的な動向や社会規範全体への影響を考慮しつつ取り組むことが求められます。

図23:生成 AI に係る著作権法上の問題(論点)

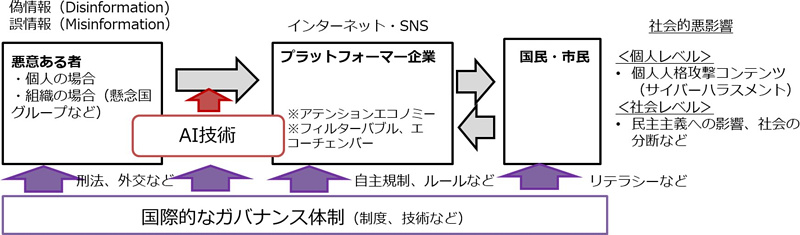

(3) 偽情報などの不適切なコンテンツの生成・流通に係る社会的リスク

また、生成 AI は、単に著作権の観点からだけでなく、社会的な観点から不適切なコンテンツをユーザーが非意図的あるいは意図的に(悪意を持って)生成し、それらを、インターネット等を通じて拡散する社会的リスクが大きな課題となりつつあります。その中でも、特に偽画像に関しては、2018 年ごろから、DeepFake 技術の登場によって社会的に問題になっていましたが、今回の生成 AI ブームにより、より容易に画像などを生成することが可能になったことから、より巧妙な偽情報・偽画像等が多量に社会に流通し、社会に悪影響を与える可能性が指摘されています。

このような社会的に不適切なコンテンツには、個々の人権を侵害するコンテンツや社会的に受容されないコンテンツから、民主主義社会にとって悪影響を与えかねないコンテンツまで含まれ、特に最近では、情報戦の一環として、海外の権威主義国等の影響力を高めるためのコンテンツなどが大きな社会的リスクとして認識されつつあります。

もともと、このようなコンテンツは、基本的には、生成 AI を利用しなくとも人間自ら作成することは可能であり、また、特に個人の人権を侵害するようなコンテンツについては、従来から、民法・刑法などにより基本的なルールが整備されてきています。また、表現の自由の観点から国の関与は限定的にすべきとの理解のもとで、印刷・放送技術の進展に伴い、事業者などによる自主ルールなどが整備されてきています。一方、近年になって、インターネット・SNS を通じた不適切なコンテンツの拡散が大きな社会的リスクとして認識され、そのガバナンスの在り方が議論されている中で、今回の生成 AI のブームが始まったという流れになります。

このような生成 AI に係る不適切なコンテンツの生成・拡散に関しては、まずは、個々の利用者におけるリテラシーの向上や、生成 AI やプラットフォーム事業者における取り組みが必要になりますが、それに加え、特に悪意ある不適切なコンテンツの拡散などに関しては、今後、現行の法制で十分なのか議論されていくものと考えられます(図24参照)。

なお、生成 AI によって生成される不適切なコンテンツには、単に文章・画像などのコンテンツだけでなく、コンピュータウイルスや化学・生物兵器の製造の容易化などの問題も指摘されており、今後、広い範囲での社会的リスクとして顕在化する可能性が指摘されています。

図24:偽情報等の問題に係る社会への影響

これまでのコラム

(第1回)イノベーションのためのガバナンス

(第2回)社会規範・倫理と技術による社会的リスク

(第3回)社会的リスクに対応する制度としてのガバナンス

(第4回)AI 技術の利用がもたらす社会的リスク

(第5回)信頼性・安全性に係る社会的リスク

(第6回)プライバシーに係る社会的リスク

(第7回)公平性・妥当性に係る社会的リスク

筆者紹介 市川 類(いちかわ たぐい)

東京科学大学 データサイエンス・AI全学教育機構 特任教授

一橋大学 イノベーション研究センター 特任教授

筆者紹介の詳細は、第1回をご参照ください。